Курсовая работа: Проблеми штучного інтелекту

Вступ

У сучасному світі, який увійшов в епоху інформації та інформаційних технологій проблема створення «розумних» технологій постає особливо актуальною. Під «розумними» технологіями на сьогоднішній день можуть розуміти машини з програмами будь-якої складності, від пральної машини, що сама обирає режим прання до роботів, що можуть малювати картини і керувати супутниками. Пройшов той період, коли тцльки деякі вчені вірили у можливість створення машини, що обраховувала б імовірність подій, зв’язно відповідала на питання, тощо. Сьогодні такий феномен як «штучний інтелект» вже глибоко увійшов у багато аспектів нашого життя. Хоча іноді ми не усвідомлюємо цього, але ідеї можливості створення розуму, подібного до людського вже давно сприймаються як належне, проникаючи у свідомість людей і відображаючись у результатах їх творчості. Але феномен «штучного інтелекту» постає перед нами не тільки у перспективі, але вже і сьогодні. Багато з програм, що вирішують багато х людських когнітивних задачують нас. А отже, проблема існування штучного інтелекту є вельми цікавою і надає велике поле для наукової діяльності.

Сучасна проблема «штучного інтелекту» полягає у вічному питанні бути чи не бути. Вже не викликає сумнівів можливість існування таких технічних засобів, що брали б на себе частину роботи людей, яку вони вони взмозі виконати краще. Сьогодні постає інше питання, чи може існувати машина, що буде повністю імітувати людську психологію. Ця проблема дуже обширна і вміщає в себе велику кількість аспектів. Щоб побудувати деяку картину сучасного її стану слід охопити хочаб деякі з них. У поданій роботі я звернула увагу на розвиток області наук, в межах якої з’явилася ця наука, когнітивної науки; також деякі філософські і методологічні питання, що стосуються створення «штучного інтелекту»; важливим питанням постає сучасні досягнення в цій області і ставлення до них суспільства; сучасні технології досягнення деяких цілей.

Для окреслення підходів до ідей створення «штучного інтелекту» у роботі розглянуто аргументи вчених, що підтримують ідею можливості цього і тих, що критикують або сучасні методи розв’язання проблеми, або взагалі можливість її ров’язання як такої. До перших належать, наприклад кібернетики Т’юринг, Бостром. До вчених, що піддають цю ідею деякій критиці належить кібернетик Бірюков, психолог Тихомиров.

За завдання у цій роботі поставлено ознайомитись з поняттям «штучного інтелекту» і змалювати сучасний стан цього питання. Також зроблено спробу передбачити сферу і перспективи майбутнього розвитку галузей, що торкаються проблеми штучного інтелекту на основі розглянутих теорій і фактів.

Частина І. Філософсько-методологічний вступ

Проблема штучного інтелекту бере своє коріння у глибинах когнітивної науки, тож для початку слід визначити що це таке. Когнітивна наука – це область міждисциплінарних досліджень пізнання, яке розуміємо як сукупність процесів накопичення, збереження, перетворення і використання знань живими і штучними системами. Існують такі дисципліни:

(Взято з Соло «Когнітивна психологія»)

Як вже було сказано, це область міждисциплінарна, тому виникає ряд труднощів, пов’язаний з цим. Одна з перших – проблема термінології. Власне перед тим як казати про проблему взаєморозуміння кількох наук, слід зазначити, що і в середині психології існують значні неточності. По-перше вже протягом кількох тисячоліть вчені не можуть домовитися про те, що ж таке свідомість, тобто не можуть визначитися з предметом науки.

Поява інформаційних технологій у 21 столітті тільки підкреслила наскільки мало ми знаємо про людську душу. Зараз стало популярним порівняння людського мозку з ком’ютером. Звичайно, це краще, ніж порівнювати його з телеграфом (Г. Гельм-Гольц) або навіть з радіоприймачем (А. А. Ухтомский). Але як і ранні порівняння, комп’ютерна метафора має великі білі плями. Так, найочевидніша різниця, це те, що у комп’ютерів, на відміну від людини, не існує свідомості. Тим не менш, інновації в комп’ютерних технологіях і порівняння з ними людини дозволяють поставати більш точні питання. Наприклад – чому око, яке можна порівняти з відеокамерою, не викривлює зображення при нахилі голови. Перераховувати такі загадки можна до нескінченності.

Серед усіх таємниць психології найбільшою лишається, все ж, таємниця свідомості. Ми сприймаємо світ і себе з безпосередньою очевидністю. І сам по собі факт наявності її настільки очевидний, що всі уявляють свідомість, але тільки до моменту, коли їх попросять сформулювати, що ж це таке. Пояснення – це знаходження способу міркування, за якого незрозуміле стає зрозумілим. Однак будь-яке пояснення свідомості буде більш незрозуміле, аніж її очевидне існування, адже виникнення свідомості не може бути результатом процесів цієї самої свідомості, а тому природа її не може бути подана з тією само, очевидністю, яка присутня поясненням її явищ.

Історично склалося, що більшість психологічних термінів є омонімами і це ще більше ускладнює ситуацію. Також, якщо розібратися у основних загальновживаних термінах, можна помітити, що будь-яке психічне явище пояснюється через специфічну властивість психіки. Це нагадує приклад, коли в середні віки горіння дерева пояснювали його здатністю до цього через наявність в ньому особливого матеріалу. Але це проблеми лише в середині самої психології, а існують також термінологічні питання на зтику наук когнітивної сфери. Для ефектиної співпраці необхідна спільна мова, але існує такий феномен як міжнаукова омонімія. Це означає, що в різних науках одне і те саме слово може позначати зовсім різні значення, що призводить до непорозуміння.

Окрім термінології існує також проблема в узгодженості наук, тобто висунення спільних припущень, які потім можуть ров’язуватися комплексними методами. Існує декілька стратегій міждисциплінарної взаємодії:

1. «Косметична дисциплінарність» - (Спербер, 2003) мається на увазі звичайна сумація міждисциплінарних проектів.

2. «Збагачення» - розширення спектру доступних даних

3. Розв’язання наукових проблем однієї області за допомогою методів іншої

4. «Граничні» проблеми: спільна постанова питань і спільний пошук відповідей на них

Щодо представлених стратегій, то вони потребують також і комплексного підходу з точки зору методології пошуку відповідей. Існує багато різних шляхів пояснення: логічний, містичний, практичний, гуманітарний і природничий. Необхідно обрати шлях пояснення, а вже у його межах – мову і, нарешті – критерії досліджень.

Існують принципово різні шляхи пізнання: містичний, що претендує на очевидність і заснований на власних відчуттях; логічний, який орієнтований на формальну вірність, відсутність протиріччя і тавтологічні перетворення; природничий, котрий намагається відшукати істину, спираючись на відповідність досліду логіки; практичний, ефективність якого визначається за результатами його практичного застосування; шлях гуманітарної науки, що претендує на осмислення всього пізнаного і опирається на традицію і ідеали.

1. Природничі теорії мають сформовані критерії обґрунтованості своїх стверджень, однак вони нечіткі, оскільки намагаються бути незалежними від суб’єктивізма, не зовсім вірні, адже будуються на ідеалізованих об’єктах, і безпосередньо на практиці не застосовуються. Тим не менш, саме вони дають найбільше наближення до істини. Психологія, відокремлюючись самостійною наукою, одночасно позиціонувала себе як науку природничу, чим прийняла важливу норму.

· Відтепер кожен психолог, що вважає себе науковцем, має обґрунтовувати свої твердження експериментом.

· І навпаки, всі дослідні дані, усі, знайдені емпірично, закони тільки тоді визнаються достовірними, коли отримують логічне обґрунтування.

· Саме обґрунтування емпіричних фактів має незалежно перевірятися.

· Не можна будувати науку, спираючись на слова буденної мови чи їх етимологічний аналіз. Тим більш не можна так будувати психологію, де більшість слів – омоніми.

2. Слід розрізняти теоретичні терміни, що входять логічний опис психічного, і емпіричні терміни, призначені для опису реальності, що спостерігаємо безпосередньо. Свідомість як емпіричний термін відображає емпіричне явище – усвідомленість.

3. Містичні переживання є реальністю. Вони виникають одночасно с появою людського мислення і, поки існує людина, не зникнуть. Кожна людина переживає їх по своєму, тим не менш, вони не можуть бути ні логічно обґрунтовані, ні достатньо точно виражені в словах. Містична істина існує лише для того, хто її знайшов, і неосяжна для всіх інших. «Мысль изреченная есть ложь».

4. Практика не може прямо свідчити про істинність. Практичні результати не залежать від того и істинна теорія лежить в основі шляхів їх досягення. Практичні технології відповідають ситуативно і лише на питання «як?», а не «чому?».

5. Тільки логіка дозволяє зрозуміти принципову простоту і однорідність природи психічного, а отже відмова від неї не можлива. Однак, логіка не може обґрунтувати сама себе, адже початково ґрунтується на аксіомах, які сприймаються як незаперечні і такі, що не потребують обґрунтувань.

Природничими методами можна вивчати неусвідомлювану роботу свідомості. Але склад свідомості, що сформувався у процесі цієї роботи, багато у чому лишається прерогативою гуманітарного знання. Свідомість людини має описуватись всіма цими методами, що так важко звести разом. При цьому ні один з них, окремо взятий, не є повним і вичерпним.

Нарис історії когнітивної психології

Перші уявлення про мислення

Звідки приходить знання і як воно представлене в свідомості? Це вічне питання має важливе значення для когнітивної психології. Були запропоновані дві відповіді: емпірики стверджують, що знання виникає з досвіду; натівісти ж стверджують, що є деякі початкові категорії, які впорядковують сенсорний досвід. З наукової точки зору ні одна з цих позицій не може бути остаточно доведена, тому суперечка триває і не дає чіткої відповіді. Вирішення цих триваючих дебатів обумовлене нашим визначенням знання як «зберігання і організації інформації в пам'яті», що відповідає позиціям обох сторін спору: прихильники «Зберігання» передбачає, що досвід набутий, а «організація» - що в нервовій системі існують деякі структурні здібності. Пам'ятаючи про ці проблеми, давайте розглянемо, як їх вирішують філософи і психологи.

Глибокий інтерес до знання ми можемо виявити в самих древніх наукових працях. Перші теорії стосувалися ролі думки і пам'яті. Аналізуючи давньоєгипетські ієрогліфічні тексти, можна зробити висновок про те, що, на думку їхніх авторів, знання локалізовано в серці, - уявлення, що розділяв і ранній грецький філософоф Аристотель. Але не Платон, який вважав, що знання знаходиться в мозку.

Пізнання в епоху Відродження і після неї.

Філософи та теологи епохи Відродження в загальному сходилися на думці, що знання знаходяться в головному мозку, причому деякі навіть запропонували схему їх будови і розташування.

У XVIII столітті, коли філософська психологія зайняла місце, призначене науковій психології, британські емпірики Берклі, Юм, а пізніше Джеймс Мілль і його син Джон Стюарт Мілль припустили, що є три типи внутрішніх репрезентацій: 1) безпосередні сенсорні події 2) бліді копії перцепт - те, що зберігається в пам'яті 3) перетворення цих блідих копій, тобто асоціативне мислення. Подібне уявлення про внутрішню репрезентацію і перетворення припускає, що внутрішні репрезентації формуються за певними правилами, а формування та перетворення потребують часу і зусиль - положення, що лежать в основі сучасної когнітивної психології.

У XIX столітті психологи спробували вирватися з рамок філософії та сформувати окрему дисципліну, засновану на емпіричних даних, а не на спекулятивних міркуваннях. Помітну роль у цій справі зіграли перші психологи: Фехнер, Брентано, Гельмгольц, Вундт, Мюллер, Еббінгауз та інші. До другої половини XIX століття теорії, що пояснюють репрезентацію знань, чітко розділилися на дві групи: представники першої групи наполягали на важливості структури уявних репрезентацій, а представники іншої групи наполягали на особливій важливості процесів. Представник другої групи, Брентано, вважав, що справжній предмет психології - це дослідження когнітивних дій: порівняння, судження й відчування. Протилежна сторона займалася безліччю тих самих питань, що обговорювали за дві тисячі років до цього Платон і Арістотель. Однак на відміну від попередніх, чисто філософських, міркувань обидва види теорій тепер підлягали експериментальній перевірці.

Когнітивна психологія: початок XX століття

У XX столітті з появою біхевіоризму і гештальт-психології уявлення про репрезентації знань зазнали радикальні зміни. Погляди біхевіористів на внутрішні репрезентації були представлені, в психологічній формулі «стимул-реакція» (S-R), а представники гештальт-підходу будували докладні теорії внутрішньої репрезентації у контексті ізоморфізму - взаємооднозначної відповідності між репрезентацією і реальністю. Наприкінці XIX століття раптом з'ясувалося, що дослідження когнітивних процесів вийшли з моди і їх замінив біхевіоризм. А починаючи з 1950-х років інтереси вчених знову зосередилися на увазі, пам'яті, розпізнаванні паттернів, образів, семантичної організації, мовних процесах, мисленні і навіть «свідомості», а також на інших «когнітивних» темах, одного разу відкинутих під тиском біхевіоризму.

Виникнення когнітивного руху і відродження питання свідомості у психології.

Як і всі істинні новації в історії психології, когнітивна психологія не з’явилася на порожньому місці. Її витоки можна прослідкувати в більш ранніх концепціях. Деякі дослідники стверджують, що «когнітивна психологія одночасно і новітня, і давня традиція в історії психології» (Heamshaw 1987). Як вже було сказано, інтерес до свідомості з’явився задовго до того. Більшість шкіл мають справу зі свідомістю. Наприклад структуралізм і функціоналізм. І лише біхевіоризм відійшов від цієї традиції і витіснив тему свідомості з порядку денного психологічної науки майже на 50 років.

Представник біхевіоризма Гатрі під кінець своєї научної карє’ри піддав критиці механістичну модель психіки і стверджував, що для визначення істинного значення тих чи інших стимулів, необхідно описувати їх у перцептивних чи когнітивних термінах (Guthrie. 1959). Ще одним попередником когнітивного руху можна вважати радикальний біхевіоризм Толмена. Цей дослідник визнавав важливість розглядання когнітивних змінних і сприяв відходженню від загальноприйнятого на той час підходу «стимул-реакція». Він також підкреслював необхідність використання проміжних змінних для визначення внутрішніх станів, що не спостерігаються. Також великий внесок у когнітивний рух зробила гештальт-психологія, оскільки в центрі її уваги, з самого початку, стояла «організація, структура, зв’язки, активна роль суб’єкта, а також важлива роль сприйняття в процесі научіння і запам’ятовування». (Hearst. 1979) Гештальт-психологія значно допомогла когнітивному руху вже тим, що підтримувала інтерес до проблеми свідомості в період панування біхевіоризма. Порередником когнітивної психології став також Жан Піаже, що провів ряд суттєвих і вагомих досліджень дитячої психології саме зі сторони стадій когнітивного розвитку. Але у США його ідеї поширення не набули, хоча вже у 20-30 роках значно впливали на європейьку психологію.

Коли ми стикаємося з такими значними змінами основних наукових концепцій, слід нам’ятати, що подібні ситуації завжди є відображенням більш глибоких перетворень, пов’язаних зі змінами самого духа епох. Наука адаптується до нових вимог. Щоб пояснити зміни у психології, слід звернутися до фізики. На початку 20х років почав розроблятися інший підхід до розуміння сутності об’єктивного світу. Галілеєвсько-ньютоніанська модель світу була відкинута, на зміну їй прийшла інша, котра піддавала сумніву основу класичної науки – ідею про можливість абсолютного відокремлення об’єкта і суб’єкта. Сучасна наука відмовляється від ролі пасивного спостерігача і позиціює себе як спостерігача, що бере у явищі участь. Саме ця подія у сучасній фізиці у значній мірі відродила інтерес до ролі свідомого досвіду в отриманні інформації про зовнішній світ і послугувала достатнім приводом для реабілітації свідомості у якості предмета психології.

Також був ряд інших новацій, що також слугували поштовхом для розвитку когнітивної психології. Наприклад: виникнення теорії зв'язку; сучасна лінгвістика, у коло питань якої були включені нові підходи до мови та граматичних структур, а також комп'ютерна наука та інші технологічні досягнення. Комп'ютерна наука, і особливо один з її розділів - штучний інтелект, змусили психологів переглянути основні постулати, що стосуються вирішення проблем, обробки і зберігання інформації в пам'яті, а також обробки мови і оволодіння нею. Вперше в історії людства з'явився автомат, який, як і людина, виявився здатним переробляти інформацію. Комп'ютери дозволяли подивитися на інформаційні процеси у людини з несподіванної сторони. Дж. Міллер зі співавторами казали, що комп'ютер можна використовувати для моделювання дії різних психологічних теорій. Пізніше, мозок взагалі став розглядатися як обчислювальний механізм, подібний до комп'ютера. Перші експерименти були багато в чому натхненні питаннями: що спільного між процесами переробки інформації у людини і комп'ютера? Чим ці процеси відрізняються один від одного? Пошук відповідей породжував незвичайні ідеї і найчастіше висловлювався на мові блок-схем, які когнітівісти запозичили в інженерів.

Когнітивна психологія дійсно породила новий погляд на психіку. Отримані нею експериментальні дані сильно змінили існуючі до цього уявлення про пізнавальні процеси. Саме когнітівізм почав, повною мірою, формувати психологію за каноном природничої науки, що поєднує логіку і експеримент. Студенти, які здають іспити з когнітивної психології, змушені міркувати й знаходити своїм міркуванням дослідне підтвердження, а прихід у науку покоління, що розмірковує змінює вигляд цієї науки.

Метафори пізнання

Комп’ютерна метафора

До символьного підходу, що виник після 60тих років, когнітивну науку підвів підхід інформаційний, який розгорнувся на теренах інформаційної теорії. Свідомість він трактував як інформаційний канал, що має обмежені пропускні здібності. Також в моду увійшли різного роду схеми і алгоритми, якими намагалися пояснити всю роботу мозку. Саму ідею комп’ютерного підходу точно сформулював один з творців інженерної психології, Кеннет Крейк: «Якщо організм несе в голові дрібномасштабну модель зовнішнього оточення і своїх можливих дій, він здатний перевіряти різні альтернативи, визначати найкращі з них, реагувати на майбутній розвиток ситуації і взагалі у всіх відносинах вести себе більш повноцінно, безпечно і компетентно, потрапляючи в складні умови»(Крейк, 1943) Використовуючи цю теорію, можна було зробити наступний крок - оголосити відмінності форм репрезентації мозку і машин поверхневими і постулювати єдиний абстрактний формат подання знань на рівні глибинних структур, що допускають алгоритмічний опис. Ось чому на початку 1960-х років процеси пізнання стали трактуватися по аналогії з процесами обчислень в комп'ютері. Розуміння того, що людина активно «переробляє інформацію», будуючи внутрішні моделі оточення, означало перехід від інформаційного підходу у вузькому сенсі слова до когнітивної психології.

Значна частина досліджень, що розгорнулися з кінця 50х років, схилялася до версії комп'ютерної метафори, пов'язаної з виявленням та аналізом можливих структурних блоків переробки інформації та принципів їх об'єднання в єдину функціональну архітектуру. Першими роботами нового напрямку можна вважати дослідження процесів утворення штучних понять Джеромом Бруне-ром і співробітниками, а також роботи Ньюела, Саймона і Шоу, які створили ряд машинних моделей мислення, в тому числі «Логік-теоретик» та «Універсальний вирішувач завдань». Комп’ютерна теорія мала тенденцію до сильного спрощення психічних процесів, наближаючи їх до прогам комп’ютерів. Такі моделі не функціонували на граничних, непевних випадках, доводилося вводити багато додаткових параметрів для кожної суперечливої ситуації.

Підсумки першого етапу розвитку когнітивної психології були висунуті у книзі Нейссера «Когнітивна психологія» 1967 року. Він пише, що конструктивний характер наших пізнавальних процесів є фундаментальним фактом. Завдання когнітивної психології полягає в тому, щоб зрозуміти, яким чином «сприймається, запам'ятовується і осмислюється світ, що породжується з такого непродуктивного початку, як конфігурація ретинальної стимуляції або візерунки звукового тиску у вусі». Найссер підкреслює, що мова йде лише про подібність, але не про ідентичність машинних програм і психічних процесів.

Протягом 1970-х років у психології і за її межами, насамперед у роботах з штучного інтелекту, склалося єдина думка щодо теоретичних підстав, методів і моделей когнітивних досліджень. Певною мірою умовно, можна виділити чотири принципи традиційної парадигми ранньої когнітивної психології:

1. Пріоритет знання й раціонального мислення над поведінкою, звичками і афектом.

2. Використання комп'ютерної метафори.

3. Припущення про послідовність переробки інформації.

4. Акцент на формальному моделюванні замість вивчення мозкових механізмів.

Модульна метафора

Комп’ютерна метафора використовувала для порівняння з мозком людини так звані «фон-нейманівські» машини, універсальні обчислювачі, які характеризувалися здатністю розділяти інформацію на пасивні дані і активні операції над ними, а ткож наявністю одного процесору. Революцію у науці спричинив винахід транзистора, а з ним і мікропроцесора. Комп’ютери з його використанням, хоч і були простіші від «фон-нейманівських», але були швидші і точніші у виконанні точних і визначених практичних завданнях. Також у цілях економії мікропроцесори почали використовувати для створення багатопроцесорних комп’ютерів, що дозволило значно скоротити час обробки інформації, шляхом розбиття задачі на під завдання і об’єднання процесорів між собою. Це і призвело до виникнення медулярного підходу.

Першим автором, що використав термін «модулярність» для опису організації психологічних процесів, був американський нейроінформатик Девід Марр. Він припустив, що «будь-який великий масив обчислень повинен бути реалізований як набір частин, настільки незалежних один від одного, наскільки це допускає спільне завдання. Якщо процес організованих не таким чином, то невелика зміна в одному місці буде мати наслідки в багатьох інших. Це означає, що процес у цілому буде дуже важко виправити або поліпшити, як шляхом втручання людини, так і за допомогою природної еволюції - адже будь-яка зміна, що покращує один із фрагментів, буде супроводжуватися безліччю компенсаторних змін в інших місцях » (Маrrі, 1976). Ідея розбиття великого масиву обчислень на відносно незалежні автономні задачі, які вирішуються спеціалізованими механізмами (підпрограмами або модулями) була очевидною для біологів та інформатиків, але спочатку залишалася малопереконливою для фахівців з когнітивної психології, цілком задоволених можливостями класичної комп'ютерної метафори. Джеррі Фодор ввів поняття модулярності і в психологію. Архітектура пізнання представляє собою, з його точки зору, швидше мозаїку з безлічі паралельних і дещо автономних у функціональному відношенні процесів, а зовсім не організоване в єдиний механізм ціле. Фодор сформулював в цілому 8 критеріїв, або ознак, які в сукупності дозволяють ідентифікувати когнітивні модулі. До них відносяться:

1. вузька спеціалізація

2. інформаційна закритість

3. обов'язковість

4. висока швидкість

5. поверхнева обробка

6. біологічне походження

7. селективність випадінь

8. фіксованості нейроанатоміческіх механізмів.

Нейронна метафора

Якщо на початку виникнення когнітивного підходу багато психологів сприйняли спочатку як звільнення від необхідності цікавитися мозковим субстратом та можливими нейрофізіологічним механізмами тих чи інших пізнавальних процесів, то протягом останнього десятиліття 20-го століття яскраво продивляється глобальна тенденція, що пов'язана із зростанням інтересу до мозкових механізмів - реальної архітектурі пізнавальних процесів.

У подальші роки з появою безлічі нестандартних архітектур в коннекціонізмі і, особливо, у зв'язку із спекуляціями про мозкову локалізацію тих чи інших «когнітивних модулів» природно стало виникати питання про те, як ці гіпотетичні механізми реалізовані насправді. Змінився і сам характер когнітивних досліджень, які в значній мірі спираються сьогодні на дані нейропсихологічних і нейрофізіологічних робіт. Починаючи з 1990-х років послабився вплив власне комп'ютерної метафори і машинних моделей.

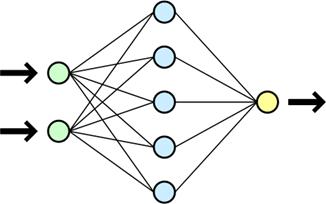

Отже, іншим впливовим підходом впродовж останніх 20 років став так званий PDP-підхід (від paralle ldistributed processing = паралельно розподілена обробка), широко відомий також як коннекціонізм. В даному випадку також іде мова про відмову від комп’ютерної метафори в її символьному варіанті. Однак, якщо концепція когнітивних модулів Федора лише допускає деяку паралельність обробки в яких-небудь частинах когнітивної моделі, то в коннекціонізмі паралельність опрацювання стає загальним принципом. Мова іде про те, що всі елементи системи, що інтерпретується як нейронна мережа, розглядаються як такі, що потенціально пов’язані між собою і одночасно беруть участь у формуванні відповіді на стимул.

Схема найпростішої мережі.

Головна перевага нейронних моделей у порівнянні традиційними когнітивними моделями полягає можливості асоціативного і розподіленого збереження інформації а також адаптивного навчання. Перша особливість означає, що будь-який фрагмент першопочаткової ситуації чи будь-яка початкова обставина здатні асоціативно підтримати пригадування. Розподіленим зберігання є тому, що його субстратом є у кожному окремому випадку не окремий елемент, а мережа в цілому, тобто стани всіх її вузлів і вагомість їх зв’язків. Нарешті, конекціонізм дозволяє природно описувати деякі елементарні форми навчання. Процеси навчання у нейронних мережах мають власну специфіку, найпростіша, суто асоціативна процедура навчання в нейронних мережах стосується класичних іде прокладення шляхів паловської фізіології.

Правило Хебба: між усіма синхронно активованими нейронами знижуються пороги синаптичних зв'язків (підвищуються вагові коефіцієнти активаційних зв'язків). В результаті багаторазових повторень поширення активації при виникненні на вході тієї ж ситуації відбувається швидше; група елементів, «ансамбль», активується як ціле, і ця активація відбувається навіть при змінах ситуації, наприклад, випаданні якихось компонентів зображення, а також «відмирання» частини «нейронів» самої мережі. Тим самим, вдається моделювати особливості цілісного сприйняття, описаного гештальтпсихології. Подібна терпимість до спотворень на вході і до порушень механізму обробки інформації разюче контрастує з тендітністю звичайних символьних програм. Крім того, пластичність синаптичних зв'язків, що лежить в основі формування ансамблів, дозволяє дати фізіологічне пояснення процесів узагальнення (категоризації) окремих ситуацій. Недоліком описаного механізму самоорганізації нейронних зв'язків є його надзвичайно повільний, що вимагає сотень і тисяч повторень, характер.

Прикладом більш ефективного комп'ютерного алгоритму навчання служить запропонований канадським інформатиком Джеффрі Хінтон і його колегами метод зворотного поширення помилки. У цьому випадку мережі пред'являється деяка конфігурація, а потім відповідь на виході порівнюється з ідеальною, бажаною відповіддю. Результат такого порівняння обчислюється і пропускається потім у зворотному напрямку: від виходу мережі до її вхідного шару, причому на кожному проміжному етапі здійснюються деякі корекції вагових коефіцієнтів зв'язків елементів з метою подальшої мінімізації неузгодженості. Але «контрольована мінімізація неузгодженості» залишає сильне враження довільного підбору бажаного результату.

Ряд коннекціоністскіх моделей використовує зворотні зв'язки для повторного пропускання продуктів обробки через нейронну мережу. Ця властивість, рекурентність, дозволяє обробляти конфігурації на вході в контексті попередніх подій («минулого досвіду»).

У настільки динамічній області, як когнітивна наука, важко прогнозувати майбутній розвиток подій. У рамках робіт з обчислювальною нейронаукою (нейроінтеллектом) і еволюційним моделюванням останнім часом починають розглядатися більш реалістичні, з біологічної і біофізичної точки зору, альтернативи штучним нейронним мережам. При збільшенні обсягу мозку в процесі еволюції вихідний мережевий принцип «все пов'язано з усім» перестає виконуватися, виникають елементи модулярної макроорганізаціі (Striedter, 2004).

У зв’язку з появою вової хвилі зацікавленості у процесах головного мозку і появою нових можливостей у технологічному плані, виникли нові методи дослідження головного мозку. Аж до самого останнього часу існували дві основні групи методів вивчення нейрофізіологічних механізмів:

Найбільш відомим з новітніх методів є позитронно-емісіонна томографія (ПЕТ). Негативним чинником є необхідність введення у кров радіоактивної речовини з нестійкими ізотопами. При активізації якої-небудь ділянки мозку, кров направляється туди, де і проходить розпад, продукти якого потім реєструються. Цей метод забезпечує високе просторове розширення але може реєструвати тільки зміни, що протікають досить повільно, не швидше хвилини.

У багатьох сенсах набагато більш ефективним методом є магніто резонансна томографія (МРТ). Цей метод дозволяє точну і доволі швидку регістра цію крім того, він не призводить до порушень організму, так як заснований на випромінені радіохвиль певної частоти окремими атомами, що знаходяться у змінному магнітному полі. В експериментальній психології цей метод використовується у вигляді функціональної МРТ, коли визначається концентрація кисню у крові. Цей показник пов”язаний з активністю нейронів у відповідних структурах мозку.

Недоліком фМРТ є низьке часове розширення (до 1 сек). Однак саме ця методика на сьогодні ший день є найточнішою.

Також існує безліч інших методів дослідження фізіологічного субстрату когнітивних функцій людини, також пов’язаних з проривом у технологічній сфері. В тому числі важливу роль зіграли розробки у мілітаристській сфері, що стали доступні для цивільного використання. Перша модель організації мозку запропонував Джон Х’юлінг-Джексон, невролог кінця 19 століття, що в своїй роботі спирався на еволюційну теорію Дарвіна. Одним з радянських вчених, що займався цією проблемою, був А. Р. Лурія. Він визначив трьохрівневу систему організації мозку. Подібні дослідження вирішують одну і ту саму задачу, стратифікацію. Тобто виділення в цілісному масиві окремих рівнів, що мають деякі спільні характеристики.

Частина 2. Порівняння штучного і природного інтелекту

Існує кілька основних питань штучного інтелекту. Наприклад про мозок. Якого роду мислячою машиною він є? Протягом століть психологічних досліджень, а особливо – кількох останніх десятиліть, відповідь на це питання починає роз’яснюватись. У потоці нових даних, поява яких завдячує використанню нових методів трьохвимірного вивчення мозку, стало непросто визначати аналоги традиційних психологічних понять і ранні когнітивні моделі, що будувалися на теренах комп’ютерної метафори. Стало остаточно зрозуміло, що, якщо мозок і можна порівняти з сучасною обчислювальною технікою, то слід пам’ятати про його відмінність. В прешу чергу відмінність полягає в існуванні еволюційного і онтогенетичного розвитку, а також у надзвичайно великій кількості елементів і зв’зків між ними. Можливо, дослідження штучного інтелекту просунулися б ще глибше, якби комп’ютер був більше скожий на мозок.

Ось порівняння мозку і комп’ютеру, що приводить Солсо.

| Кремнієві комп'ютери | Вуглеводневий мозок | |

| Швидкість обробки | Наносекунди | Від мілесекунд до секунд |

| Тип | Послідовний процесор | Параллельний процессор |

| Ємність пам'ті | Більша для оцифрованої інформації | Більша для зорової і мовної інформації |

| Матеріал | Кремній і систма електронного забезпечення | Нейрони і система органічного забезпечення |

| Взаємодія | Абсолютно керований | Має власну точку зору |

| Здатність до навчання | Керується правилами | Понятійний |

| Краща якість | Швидкість обробки інформації, керованість, передбвчуваність | Легко робить висновки, узагальнення, виносить судження. Мобільний. |

| Найгірша якість | Не може вчитися самостійно, погано виконує складні когнітивні функції, знижена мобільність. | Має обмежену здатність до обробки і збереженння інформації, здатен до забування. |

Для того, щоб поглибити досягнення у сфері штучного інтелекту слід спершу відповісти на питання як машина може імітувати мислення людини. Однією з найпоширеніших відповідей на цей час є така, що приймає точку зору коннекціонізму. Тобто сверджується, що найкращим способом є моделювання машин за принципом будови основних нервових структур.

Також, на основ відповіді на попереднє питання виникає нове, що постає основною проблемою на сучасному етапі розвитку наук, що займаються створенням штучного інтелекту. Якщо змоделювати штучну людину, при цьому врахувавши всі недоліки справжньої істоти, чи можливо, щоб комп’ютер перевершив живу істоту? Адже вже зараз деякі програми працюють ефективніше за людське мислення. Але більшість з них, на даний момент, лише грубі бідробки тонкого мисленнєвого апарату людського мислення. Комп'ютери можуть вирішувати деякі завдання, наприклад складні математичні, швидше і точніше, ніж люди, але завдання, що вимагають узагальнень та навчання новим патернам поведінки, люди вирішують краще комп'ютерів.

Для більш-менш об’єктивного порівняння можливостей мозку і комп’ютеру можна взяти показник потужності кожного. Спробуємо оцінити потужність людського мозку комп'ютерними мірками. Він складається з приблизно 100 млрд. нейронів. Кожен нейрон представляє собою мініатюрний «процесор» і пов'язаний з іншими нейронами 5 тисячами синапсів. У зв'язку з хімічною природою передачі інформації, затримка нейрона становить 0.01 сек., тобто робоча частота нейрона близько 100 Гц. Кожен сигнал синапсу можна оцінити приблизно в 5 біт. В результаті отримуємо потужність одного нейрона – 1000000 оп / с. Для всього мозку - 10 ^ 17 оп / с. На сьогоднішній день середній домашній комп'ютер володіє продуктивністю 10 ^ 9 оп / с, найпотужніші у світі комп'ютери - приблизно 10 ^ 13 оп / с, що поки в 10 тисяч разів менше потужності людського мозку.

Слід враховувати, що просте порівняння потужності не може охарактеризувати ефективність інтелекту. Людський мозок має оптимізовану найкращим чином організацію, здатність використовувати досвід минулих поколінь, володіє самонавчанням, самореструктурізаціею. Щоб оцінити продуктивність одного тільки зорового апарату людини досить згадати, що кожну 1/16 секунди він аналізує зображення, що в тисячі разів перевищуе здатність до розрішення найсучасніших фотокамер. За цей час мозок встигає виділити окремі об'єкти, співвіднести їх з минулим досвідом, зарахувати до певних груп, зіставити інформацію лівого і правого ока, на підставі чого прорахувати відстань до кожного з об'єктів, направити зіницю в найбільш ефективну крапку в контексті досліджуваного образу.

Отже, наврядчи на даному етапі можна говорити про вже існуюче перевершення людського мозку штучним інтелектом. Поки що не збудуться жахи, що вже давно передрікає нам наукова фантастика.

Приклади існування штучного інтелекту

Позиціюючи проблему штучного інтелекту як дуже актуальну і сучасну, неможливо не токнутися того, як саме він використовується в сучасному суспільстві. Так як ми розглядаємо штучний інтелект з психологічної точки зору, слід також охопити віяння, які він привносить до свідомості суспільства.

Шаховий комп’ютер

Майбуть найпопулярнішим прикладом штучного інтелекту є шаховий комп'ютер - спеціалізований комп'ютер для гри в шахи. Ідея автомата, що дозволяв би грати у шахи за відсутності партнера виникла ще в 18 столітті. У СРСР з середини 80 років випускалися споживчі шахові комп'ютери

Сьогодні шахові програми використовуються доволі повсякденно, як і задумувалося в 18 столітті, вони допомагають замінити реального супротивника. Іноді, навіть, перемагають чемпіонів світу. Наприклад один з матчів Каспарова і DeepBlue завершився нічиєю. Але що саме лежить в основі висловлювання «комп’ютер проти людини»?

Алгоритм, який використовується програмістами IBM, призначений для пошуку потрібних ходів серед усіх можливих комбінацій. Обмежені апаратні засоби, у свою чергу, змушують вчених шукати варіанти зменшення часу пошуку без значної втрати якості. За словами Кемпбелла, алгоритм Deep Blue передбачає кількісну оцінку кожного ходу. Оцінюється він за наступними параметрами:

1. Чи дасть перевагу на дошці? Ходи, що ведуть до поразки комп'ютера, відкидаються відразу ж.

2. Популярність даного ходу. Для цього в Deep Blue довелося впровадити базу даних з інформацією про шахові поєдинки серед професіоналів. Хід, до якого в схожій ситуації вдалися багато хто з гросмейстерів, має шанси заробити більше "очок".

3. Рівень майстерності гросмейстерів, які скористалися цим ходом. Таким чином, хід, зроблений чемпіоном світу, отримує більш високу оцінку.

4. Відносна частота даного ходу. Чим частіше хід зустрічається в інших іграх, тим вище ймовірність його оптимальності в схожій ситуації.

5. Наявність коментарів до ходу. Багато спортивних коментаторів у репортажах з шахових матчів вказують на сильні і слабкі ходи гросмейстерів. Якщо певний хід був названий "сильним", то його шанси стати обраним зростають.

Як видно, ніякої містики в роботі DeepBlue немає. В основному наявність "розумної" програми передбачає реалізацію в ній якісного механізму відбору комбінацій. Тому і словосполучення "людина проти комп'ютера" в даному випадку втрачає сенс, тому що з іншої сторони дошки знаходиться не "інтелектуальна" машина або комп'ютерний продукт, а всього лише програма, розроблена і впроваджена все тими ж homo sapiens.

MYCIN

Це експертна система, розроблена на початку 1970х років в Стендфордскому університеті. MYCIN була спроектована для діагностування бактерій, що викликають важкі інфекції, такі як бактеріємія і менінгіт, а також для рекомендації необхідної кількості антибіотиків в залежності від маси тіла пацієнта. Також MYCIN використовувалася для діагностики захворювань згортання крові.

MYCIN оперувала за допомогою досить простої машини виводу, і база знань з приблизно 600 правил. Після запуску, програма ставила користувачеві (лікарю) довгий ряд простих «так / ні» або текстових питань. В результаті, система надавала список підозрюваних бактерій, відсортований за ймовірністю, надавала список питань і правил, які привели її до саме такого ранжування діагнозів, а також рекомендувала курс лікування.

Незважаючи на успіх MYCIN, вона викликала дебати з приводу правомірності її виводів. Дослідження, проведені в Stanford Medical School, виявили, що MYCIN пропонує прийнятну терапію приблизно у 69% випадків, що краще, ніж у експертів з інфекційних хвороб, яких оцінювали за тими ж критеріями. Фактично, MYCIN ніколи не використовувалася на практиці. І не через низьку її ефективність. Деякі дослідники піднімали етичні та правові питання, пов'язані з використанням комп'ютерів в медицині - якщо програма дає неправильний прогноз або пропонує неправильне лікування, хто має відповідати за це? Тим не менше, найбільшою проблемою і справжньою причиною, чому MYCIN не використовується у повсякденній практиці, був стан технологій. У наш час, подібна система була б інтегрована з системою медичних записів, отримувала б відповіді на свої запитання з бази даних про пацієнтів, і була б значно менш залежна від введення інформації лікарем. У 1970-х, сеанс роботи з MYCIN міг легко зайняти 30 хвилин і більше - що становить неприпустимі втрати часу.

Головними труднощами, з якою зіткнулися по час розробки MYCIN і наступних експертних систем, було «витяг» знань з досвіду людей-експертів для формування бази правил. Зараз даними питаннями займається інженерія знань.

Розпізнавання мовлення

Перший пристрій для розпізнавання мовлення з'явилося в 1952 році, воно могло розпізнавати вимовлені людиною цифри. Комерційні програми з розпізнавання голосу з'явилися на початку 90 років. Зазвичай їх використовують люди, які через травми рук не в змозі набирати велику кількість тексту. Наприклад, Dragon NaturallySpeaking, Voice Navigator. Збільшення обчислювальних потужностей мобільних пристроїв дозволило і для них створити програми з функцією розпізнавання мови. Серед таких програм варто відзначити Microsoft Voice Command. Інтелектуальні мовні рішення, що дозволяють автоматично синтезувати і розпізнавати людську мову, є наступним етапом розвитку інтерактивних голосових систем (IVR). Останнім часом у телефонних інтерактивних програмах все частіше використовують системи автоматичного розпізнавання і синтезу мови. При цьому системи розпізнавання є незалежними від дикторів, тобто розпізнають голос будь-якої людини. Наступним кроком технологій розпізнавання мовлення можна вважати розвиток так званих Silent Speech Interfaces (SSI) (Інтерфейсів безмовного Доступу). Ці системи обробки мовлення базуються на одержанні й обробці мовних сигналів на ранній стадії артикулювання. Даний етап розвитку розпізнавання мовлення викликаний двома істотними недоліками сучасних систем розпізнавання: надмірна чутливість до шумів, а також на необхідності чіткої і ясної мови при зверненні до системи розпізнавання. Підхід, заснований на SSI, полягає в тому, щоб використовувати нові сенсори, які не піддаються впливу шумів як доповнення до оброблених акустичним сигналами.

| Класифікація систем розпізнавання мовлення | ||||

| За якостями | За роміром словника | |||

| Диктозалежні | Дикто незалежні | Обмежений темою набір слів | Словник великого розміру | |

| За типом структурної одиниці | ||||

| Аллофон | Фонема | Дифон, трифон | Слово, фраза | |

| За типом мовлення | За метою | |||

| Ізольовані слова | Цілісне мовлення | Командні системи | Системи диктування | Системи розпізнавання |

| За механізмом функціонування | ||||

| Найпростіші детектори | Експертні системи | Вірогіднісно-мережеві системи | Зворотні задачі |

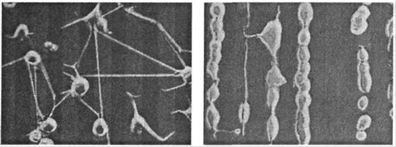

Також існує безліч менш глобальних, але безперечно цікавих і оригінальних винаходів. Таких як, наприклад в той час як американські вчені минулого покоління безуспішно намагалися побудувати комп'ютер, подібний мозку, японський вчений створив такий комп'ютер, використовуючи реальні нервові клітини, змішані з електронними пристроями, в спробі виготовити на половину штучну нейронну мережу. Він успішно поєднав клітини з напівпровідниковю сумішшю індію та окису олова і виявив, що при дуже слабкій електричній стимуляції органічні клітини реагують керованим зростанням. Занадто рано думати про штучний мозкок, але подібні пристрої могли б виступити в ролі інтерфейсу між нервовою системою і такими протезами, як штучні очі.

(Малюнок ілюструє ріст клітин при малому електричному стимулюванні)

Також одним з популярних нині напрямків є робототехніка. На даний момент існує велика кількість видів роботів. Від звичайних маніпуляторів до таких, для створення яких використовується штучний інтелект. Найближчим до нас прикладом такого «розумного» роботу може бути Sam. Він був створений фірмою Samsung на базі нетбука і запущений до найбільших вузів України. Мета цього – привернення уваги молоді до передових інформаційних технологій.

Під час турне робот має спілкуватися зі студентами, встановлюючи при цьому справжній живий діалог. Щоб зав'язати спілкування, SAM має під'їжджати до студентів і, наприклад, питати, як потрапити в деканат, бібліотеки або кабінет ректора. Його співрозмовники, у свою чергу, можуть вводити свої питання в чат-інтерфейсі на клавіатурі нетбука Samsung і отримувати відповіді. Причому SAM може не просто виводити відповіді на екран нетбука в вигляді тексту, але і озвучувати їх.

Турне робота охопить усі куточки країни - від Львова до Донецька і від Києва до Одеси.». 12 травня робот відвідав ряд корпусів Київського національного університету ім. Т. Шевченка. «SAM уособлює симбіоз реального та віртуального спілкування, звичний для активних користувачів соціальних мереж.», - зазначив Костянтин Череповський, PR-менеджер компанії« Samsung Electronics Україна». На власному досвіді спілкування з даним представником сучасної «інтелектуальної» теми я можу сказати, що він має досить дружній інтерфейс. Зображення очей на екрані, що рухаються в момент, коли комп’ютер обробляє відповідь, дещо посилює враження живого спілкування. Також SAM підтримує відносно живий і інтнлнктуальних діалог, за допомогою вбудованої веб камери може розпізнавати зображення (наприклад наявність окулярів на обличчі). Одним з помічених мною недоліків є затримка з відповіддю. Іноді обробка її вимагає досить великого часу. Також відчуття «живого діалогу», який постульований компанією виробником, дещо знижується через необхідність вводити відповіді з клавіатури. Загалом така подія має стати вельми захоплюючим і інформативним досвідом для студентів вузів, в яках SAM побуває.

Ставлення суспільства

Таке глибоке входження штучного інтелекту в наше повсякденне життя не може не викликати появи різних суджень і точок зору з цього приводу.

Якщо розглядати тенденції, що намітилися серед світових релігій, то загалом вони не заперечують можливості створення штучного інтелекту, а деякі навіть активно підтримують. Цікавою є точки зору послідовників авраамічних релігій. За однією з них мозок, роботу якого намагаються імітувати системи не бере участі в процесі мислення, не є джерелом свідомості і будь-який інший розумової діяльності. Відповідно до іншої, мозок бере участь в процесі мислення, але у вигляді «передавача» інформації від душі. Мозок відповідальний за такі «прості» функції, як безумовні рефлекси, реакція на біль тощо. Обидві позиції, на даний момент, зазвичай не визнаються наукою, так як поняття душа не розглядається сучасною наукою в якості наукової категорії.

Найкраще, на мою думку, сучасне ставлення суспільства до ідеї створення штучного інтелекту відображає мистецтво. Наприклад науково-фантастичні фільми, романи, тощо.

У науково-фантастичній літературі штучний інтелект частіше всього зображується як сила, яка намагається повалити владу людини («Космічна одіссея 2001 року», Скайнет, Colossus, «Матриця», «Той, що біжить по лезу») або обслуговуючий гуманоїд («Двохсотрічна людина», «Зоряні війни»).

Цікаве бачення майбутнього представлено в романі «Вибір за Т'юрингом» письменника-фантаста Гаррі Гаррісона і вченого Марвіна Мінські. Автори міркують на тему втрати людяності в людини, у мозок якого була вживлена ЕОМ, і придбання людяності машиною з штучним інтелектом, в пам'ять якої була скопійована інформація з головного мозку людини. Деякі наукові фантасти, наприклад Вернор Віндж (Grimm’s World, The Witling, A Fire Upon the Deep), також роздумували над наслідками появи штучного інтелекту, яке, мабуть, викличе різкі драматичні зміни в суспільстві. Одні з найбільш глибоких досліджень проблематики штучного інтелекту проявляються у творчості фантаста і філософа Станіслава Лемма, що напсав такі відомі твори як Солярис, Людина з Марса, Кіберіада, Казки роботів, тощо.

Отже, загалом можна підвести підсумок, що загалом людство не довіряє таким складним технологіям і в деякій мірі боїться їх не контрольованості,але разом з тим радо користується досягненнями вчених у цій сфері не задумуючись над цим. Про це можна судити з того, що тема штучного розуму, що захопив світ є досить розповсюдженою і популярною. Але окремі особистості, що схильні глибше іти у своєму пізнанні і розумінні проблеми штучного інтелекту, натикаються на величезну кількість етичних і глибоко філософських проблем, що він підіймає самою можливістю свого існування.

Частина ІІІ. Гностична діяльність штучного інтелекту

Гностичну діяльність машини я розгляну на прикладі комп’ютерного зору і сприймання мови. Зорова модальність – найголовніша для людини, так як машини у пізнанні світу імітують нас, то і в них зорове пізнання лишається одним основних джерел інформації. Проблеми мовлення я торкнулася через те, що це одна з тих сфер, в якій активно бере участь психологія. Існує два способи за якими машина може обробляти інформацію, що надійшла з зовнішнього світу.

Перший подібний до дії простих рефлексів. Тобто з усього каналу інформації витягається частина, що відразу надсилається на відповідні її модальності аферентні структури або спочатку поєднується з іншою інформацією. Машини, що працюють за такою схемою досить швидко реагують на зовнішні подразники і у відповідь певним чином змінюють свою програму дій.

Альтернатива цьому підходу – підхід модельний. Тобто стимули, що надійшли ззовні спочатку конструюють модель зовнішнього світу. При цьому робота починається функції. Що відображає стан світу W на окремі стимули S. Ця функція S = f (W) добре відома і вирішується в області комп’ютерної графіки. Робота ж комп’ютерного бачення прямо протилежна до завдання комп’ютерної графіки, тобто ми повинні обрахувати W через S. Але в цьому і полягає проблема, бо з картини світу ми не в змозі відновити всі аспекти його існування. Інша проблема цього методу полягає у надмірності задач, поставлених перед програмою. Щоб вирахувати функцію f у комп’ютерній графіці для 1 кадру може знадобитися біля кількох годин, а для вирахування оборотної функції – ще більше. До того ж, на відміну від промальовування комп”ютерної графіки, штучному інтелекту для виконання його завдань рідко коли потрібна настільки детальна картина світу.

Формування зображення

Світло, що розсіюється предметами на «сцені» концентрується у процесі зору і утворює двовимірне зображення. Площина, на якій утворюється зображення, покрита фото чутливими елементами, наприклад фоторецепторами, галогенами срібла або елементи з зарядовим зв’язком (Charge-Coupled Device —

CCD). На початкових етапах розпізнання візуальних об’єктів комп’ютер проходить через ряд елементарних функцій, для того, щоб потім перейти до більш складного аналогу зображення. Це відповідає сенсорним процесам і процесам елементарної обробки візуальної інформації у зоровому аналізаторі людини.

Сенсорні процеси

Світло

Програма розпізнавання об’єктів починає з обробки яскравості пікселів отриманого на площині зображення. Яскравість залежить від кількості фотонів, направлених на фото чутливий елемент з деякої точки сцени, де інтенсивність переводиться в відносні одиниці, розмах яких тим більший, чим більше бажане розширення і точність результату. Кількість світла (фотонів) залежить від багатьох факторів, таких як вид відбиваючої поверхні і інші елементи сцени, що також можуть розсіювати світло. Існує кілька видів поверхонь, більшість реальних матеріалів поєднують у собі розсіювальні і поглинаючі характеристики. Саме моделювання таких об’єктів є головною задачею комп’ютерної графіки, метод полягає в імітуванні фізичного джерела світла і подальшого багаторазового відбивання променю.

Колір

Колір у фізичному сенсі програмується комбінацією хвиль деяких частот. Чистими, одно частотними, кольорами є тільки сім, що входять у веселку. Але це не означає, що для створення кольорового зображення необхідно оперувати всіма сімома, експерименти, розпочаті ще Томасом Юнгом доводять, що для створення будь-якого кольору, принаймні такого, що може сприйматися людиною, достатньо оперувати трьома довжинами хвиль: червоний – 700 нм, зелений – 546 нм, синій – 436 нм. Правильність такого підходу підтверджує людська зорова система, що складається з трьох видів колбочок.

Перший етап обробки зображення

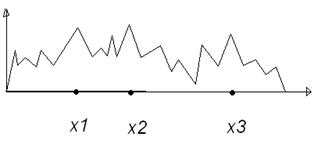

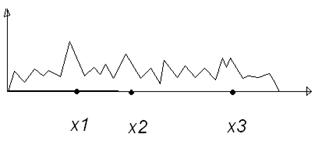

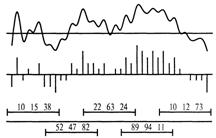

Перший етап обробки зображення полягає у підготовці зображення до розпізнавання, тут прибирається шум (згладжування) на зображення і розпізнаються його контурів, сегментація. Ці операції проводяться локально, тобто для окремої групи пікселів, не зважаючи на все зображення, для їх виконання немає потреби у розумінні який саме об’єкт зображено. Саме тому такі початкові операції можуть проводитися паралельно. Операція згладжування проводиться на основі обрахування значення яскравості пікселя на основі значень яскравості його елементів. Як значення яскравості береться середнє значення яскравості сусідніх пік селів, а для визначення кількості таких пік селів, що слід взяти для обрахунку існує спеціальна формула гауса. Наступною операцією є віднаходження країв, тобто ліній розділювачами для областей зі значною різницею в яскравості. Контури зазвичай відповідають важливим об’єктам на сцені. Така операція необхідна для зняття перенасиченості і перевантаження деталями картини, перетворення її у більш абстраговану, узагальнену. Контури відносяться тільки до такої, окремо взятої експозиції і тому не можуть дати визначення об’єктам, що на ній знаходяться. Але вони допомагають в цьому у ході подальшої обробки зображення. Краї, що утворюються не є точними. Деякі окремі частини, що на сцені утворюють одну лінію, не з’єднуються у цілісність на отриманому зображення. Деякі з країв утворені шумом і не несуть смислового навантаження. Це пояснює необхідність проведення попереднього прибирання шуму, бо шумові пік селі створюють додаткові пікові точки, що призводить до виникнення шумових контурів. На малюнку зображено зниження інтенсивності шумових пікових точок х2 і х3 і константність істинної пікової точки х1.

а) Попіксельна діаграма зображення до згладжування

б) Попіксельна діаграма після згладжування

Після такої обробки слід об’єднати окремі пік селі країв у власне краї. Для цього користуються допущенням, що будь-які пік селі, що знаходяться поруч і мають однакову орієнтацію складають одну лінію краю.

Так як машинне сприйняття побудоване на реалізації загальних принципів сприйняття людини, то наступною операцією стає та, що призводить до утворення конгруентного образу, адже мозок людини не сприймає навколишній світ як набір точок, а виділяє з нього деякі цілісні об’єкти. Як і мозок людини (мова іде про першоразове сприйняття деякого предмету чи явища, а не послідуюче його сприйняття, де багато залежить від попереднього досвіду і його узагальнення), машина розбиває цілісно сприйняту картину світу на групи. Розбиття проходить на основі врахування особливостей характеристик пікселів, адже можна допустити, що у межах одного об’єкта вони змінюються мало. Але таке розбиття, що базується на елементарних і низькорівневих знаннях про зображення часто може призвести до помилок і хибних результатів. Для уточнення слід використовувати високо рівневі знання про те, які саме предмети можуть зустрітися вданій схемі.

Другий етап обробки інформації, витягання трьохвимірного зображення.

Мета сприйняття і обробки візуальної інформації – взаємодія з оточуючим світом. Сцена навколишнього середовища є тривимірною, а тому для успішної взаємодії з нею машині необхідні знання не про двовимірне зображення, а про тривимірну модель. Для переводу зображення у модель необхідно завершити процес розпізнавання об’єктів, який було розпочато на елементарному рівні. Після цього, витягаючи інформацію як з даної картини, так і з деяких узагальнених відомостей про об’єкт машини, подібно до людини, може побудувати цілісний, конгруентний образ предмету.

Для початку слід завершити процедуру сегментації, розпочату ще на елементарному рівні. Також в розпізнавання образу входить визначення орієнтації і позиції образу відносно суб’єкта сприймання, визначення його форми. Це, власне і є витягненням тривимірної інформації з зображення. Орієнтація і позиція об’єкта є однією з найважливіших елементів інформації, так як дозволяє орієнтуватися у просторі. При зміні положення предмету відносно камери, незмінною лишається лише форма предмету, тобто форма грає роль у зберіганні, деякою мірою, константності упізнавання предмету при зміні його положення у тривимірному просторі. Але найбільш вагомою функцією форми є розпізнавання об’єкту з можливістю його подальшої класифікації.

Тепер постає питання, як же дістати інформацію про третій вимір з початкового зображення. Для цього у людській зоровій системі передбачено багато можливостей, які можна класифікувати за загальним принципом дії: бінокулярні і монокулярні.

Ось приклад такої класифікації за Величковським:

| Ознаки глибини | Бінокулярність/ монокулярність | Абсолютність/ відносність | Якісність/ кількісність |

| Бінокулярний паралакс | Б. | В. | К. |

| Вергентні рухи очей (до 3 м) | Б. | А. | К. |

| Акомодація хришталика (до 2 м) | М. | А. | К. |

| Монокулярний параллакс (руховий) | М. | А./В. | К. |

| Перекриття поверхонь, текстур | М. | В. | Я. |

| Градієнти величин, густини | М. | А./В. | К. |

| Знання розмірів, віддаленності | М. | А. | К. |

| Висота положення у полі зору | М. | В. | К. |

| Розмирість контурів, колір | М. | В. | К. |

| Розподіл світла і тіні | М. | В. | Я./К. |

| Розділення на фігуру і фон | М. | В. | Я. |

Тепер можна розглянути за допомогою яких ознак машина будує третій вимір. Кожна з них має деякі недоліки, а в сумі всі разом дають досить точну картину сцени.

Рух

Відеокамери дозволяють отримувати до кількох десятків кадрів за секунду і різниця між кадрами може стати вагомим джерелом інформації про третій вимір сцени, така послідовна у часі зміна у зображенні одного об’єкту називається оптичним потоком. З нього витягуються дані, за якими будується модель, такими даними можуть стати напрям вектору руху, швидкість зміни зображення, прискорення зміни зображення, тощо.

Бінокулярні стерео дані.

Якщо машина створена за подобою людини, то має отримати від свого творця і дуже важливу деталь – бінокулярний зір. Бінокулярна побудова тривимірного зображення побудована на принципі, що ми розглянули вище. Тільки діставання кількох зображень досягається не за рахунок руху, а за рахунок сприймання одночасно двох різних зображень. Різниця між ними полягає у зсуну тості одне відносно одного, а отже після співставлення двох зображень буде ідентифікована неузгодженість. Третій вимір відновлюється на основі аналізу дивергенції осей зору і неузгодженості зображень, вираховуючи відстань до об’єкта за геометричними правилами.

Градієнти текстури

Під текстурою у повсякденному житті розуміється властивості об’єктів, пов’язані з тактильними відчуттями, що вони викликають. А у проблемі зорового сприйняття простору – наявність малюнку, що повторюється на поверхні і який може бути віднайдений візуально. Також до текстури відноситься і поняття густоти – частоти розташування елементів малюнку текстури, текстелів. Існує дві причини, через які однаковість малюнку може викривлюватись: різні відстані між камерою і текстелами; різні ракурси на тек стели. За допомогою математичного аналізу можна створити градієнти текстури, тобто показники швидкості зміни різних характеристик текстелів. Для відтворення даних про форму машини виконують двофазне завдання

1) вимір градієнтів текстур

2) оцінка значень можливих змін форми і положення, що могли б призвести до такої зміни текстури

Затінення

Затінення – зміна інтенсивності світла, визначається геометричною

будовою сцени і характеристиками поверхонь. Задачу по відтворенню характеристик сцени за яскравістю пік селів майже неможливо розв’язати і такий спосіб обрахунку третього виміру застосовний тільки в найпростіших випадках. До складнощів призводить велика кількість взаємо відбивань променів при наявності великої кількості предметів з різними, невідомими коефіцієнтами заломлення. Безсумнівно, люди здатні до такого типу аналізу навколишнього світу, тому вказана проблема є одним з напрямків для подальшого вивчення.

Контури

Контурний малюнок може дати нам велику кількість інформації про взаємо розташування предметів на ньому, нахилі і попороті поверхонь. Таке відчуття може досягатися завдяки поєднанню знань вищого рівня (досвіду) зі знаннями нижчого (ситуативними). Всі лінії на малюнку можуть приймати багато значень, і важливою задачею постає розмітка їх, тобто оцінка значення кожної з них. Саме ця задача була однією з найперших, що вивчалася у розділі машинного зору. Кожну лінію можна віднести до проекції лімба (сукупність точок, що ми бачимо там, де лінія зору походить по дотичній до поверхні) чи краю (звичайна лінія). При цьому краї діляться на вгнуті, опуклі чи закриваючі (ті, що закривають те, що знаходиться за ними). Кожній лінії можна присвоїти символ, що буде позначати її вид, такий символ називають міткою. На прикладі тригранних об’єктів Хаффмен і Клоувс незалежно один від одного створили повний перелік всіх можливих групувань цих видів контурів. При використанні цього словника об’єднань при аналізі контурного малюнка необхідно вирішувати задачу визначення того, які поєднання є співставні. Для цього існує правило, за яким кожній лінії можна присвоїти тільки одну мітку.

Розпізнавання об’єктів.

У людській свідомості усі об’єкти класифіковані. Ця класифікація випрацьовується протягом усього життя і відрізняється високим ступенем узагальненості. В області штучного інтелекту здатність розпізнавати предмети прийнято називати розпізнаванням об’єктів. До цього відноситься як розпізнавання класів об’єктів (собака) так і одиничних об’єктів (мій собака Рекс). Люди можуть розпізнавати не тільки об’єкти, але і види діяльності, наприклад посмішку, біг, писання, тощо, але для машин розпізнавання такого високого рівня знаходиться ще у стадії розробки. Складності викликає навіть елементарне розпізнавання об’єктів, адже машина має робити це незалежно від освітлення, оточення, положення, умов бачення.

Насамперед постає проблема сегментації об’єктів. Існує два способу детектування об’єкту. «знизу-вверх» і «зверху-вниз». Перший з них може призводити до багатьох помилок, але є на багато простішим для обрахунку. Віг полягає у розбитті об’єктів на сегменти і аналіз сегментів. Другий спосіб, що зазвичай використовується у всіх системах, вимагає складних обрахунків, адже полягає у пошуку необхідного об’єкта на площині всього зображення. На даний момент перспектива вбачається у розвитку і покращенні першого методу.

Іншою задачею є розпізнавання об’єкту незалежно від модифікацій його форми чи положення. Слід зазначити, що зміни між об’єктами всередині класу і через модифікації станів носять різний характер. Одним з варіантів розв’язання цієї проблеми є зведення об’єктів до початково заданого стану, але для цього необхідно задати всі об’єкти.

Існує два підходи до розпізнавання об’єктів: розпізнавання з врахуванням яскравості і розпізнавання з врахуванням характеристик. При обранні першого методу за основу береться пошук області пікселів, що відповідає шуканому об’єкту і обробка цієї області. Цей спосіб ґрунтується на аналізі необроблених зображень. Другий метод навпаки, використовує вже сегментовані зображення. Це допомагає досягнути скорочення часу детектування образу і досягнення інваріантності освітлення.

Цікавою задачею також постає оцінка пози, тобто позиції і орієнтації, об’єкту. Це відіграє велику роль при необхідності маніпулювання предметами. Задача вирішується досить просто і визначено, для цього використовується метод вирівнювання. В його основу покладено порівняння контурів проекції тривимірної моделі при її трансформації і двовимірного зображення.

Комп’ютерна мова

Одна із важливих задач, що стоїть перед сучасними комп”ютерами – розпізнавання і генерація поми. Мова – домінуюча форма спілкування у людей. Розпізнавання мови можна інтерпретувати як власне розпізнавання порядку слів, що було сказано або ж як ідентифікацію смислу фрагментів мовлення. Мова – доже складна система, для комп’ютерів особливо складним виявляється велика її зашумленість під зашумленістю мови можна розуміти як звичайні фізичні шуми, так і нескінченну кількість варіантів вимови. Саме це підштовхнуло вчених до думки, що розпізнання мови має будуватися на імовірнісній основі. Основні моделі, що використовуються у розпізнавачах мови зазвичай дуже прості. Наприклад модель двослівних поєднань вираховує вірогідність використання одного слова, в залежності від іншого. Таке обрахування необхідне при появі у словосполученні омофонів. В основі розпізнавання мови лежить те, що у всіх мовах використовується в основному досить обмежений і однаковий набір фонем (40-50). Але є і такі, що використовуються тільки в окремих мовах.

Звуки мови

Сприйняття звуків для машини проходить з допомогою мікрофону і аналогово-цифрового перетворювача, що виміряє величину струму, у який мікрофон перетворив коливання мембрани. Для обробки мови зазвичай використовуються частоти від 8 до 16 кГц. Хоча звукові частоти мови і досягають таких високих значень, але зміна змісту сигналу проходить набагато рідше, приблизно 100 Гц. Через це, для зменшення об’єму опрацювання інформації, при аналізі використовують більші проміжки часу, фрейми (~ 10 мс). У межах кожного фрейму його характеристики задаються векторами.

1) частотний ряд деякого звуку.

2) Оброблений сигнал

3) Фрейми з виділеними характеристиками (3)

У реальних системах використовуються сотні таких характеристик фреймів, але все ж. очевидно, що при такій обробці деяка частина інформації втрачається. Задача обробки звукової інформації полягає у тому, щоб, знищивши усі шуми на кшталт гучності, швидкості промови, тощо, вичленувати центральні характеристики, що є основними для даного звуку. Допомагає у цьому також класифікація фонем за їх складом. Наприклад якщо подібним образом описувати букву «т», то можна сказати, що вона складається з трьох станів: тихий початок, невеликий вибух (звільнення повітря) в середині і, як правило, шипіння у кінці.

Логічні системи в мові

Для того, щоб підтримувати розмови з людьми необхідно вміти розпізнавати зли тну мову, а не тільки окремі її елементи.. але насправді, зв’язна мова це не просто послідовність її елементів. І послідовність найбільш імовірних слів не є найбільш імовірною послідовністю слів. Отже, вирахувавши найбільш імовірні слова за використанням фонем, машина не може точно визначити речення в цілому, адже використання слів значно змінюється в залежності від того, в оточенні яких слів воно знаходиться і на якій позиції. Інша проблема – проблема сегментації, тобто розрізнення кінця одного слова і початку іншого, адже зазвичай у повсякденному мовленні у реченні між словами немає пауз. Як і більшість проблем у розпізнанні мови, ця задача вирішується на базі імовірнісних обрахунків.

Розуміння мови

Розробка способів розуміння природного мовлення є одним з найперспективніших і найнеобхідніших напрямків розвитку галузі штучного інтелекту. Цей напрям базується на методах логічного та імовірнісного пред’явлення знань і формуванні роздумів. На відміну від інших областей штучного інтелекту, саме ця потребує детального дослідження поведінки людей, адже мова – засіб комунікації, притаманний тільки їм і у великій мірі відображає людську психологію. Люди посилаюсь інформацію, закодовану у мові, з метою досягнення деяких цілей, мовленнєві акти є нічим іншим, як спробою примусити інших суб’єктів зреагувати певним чином. Мова – єдина в своєму роді знакова система, що використовує граматику для генерації структурованих повідомлень, що характеризуються необмеженою різновидністю. Усі варіанти використання мови є ситуативними, тобто смисл фрагменту мовлення залежить від ситуації, в якій був створений.

Для покращення розуміння граматичних схем, машини можуть використовувати розширення граматики, тобто граматику визначених висловлювань (Definite Clause Grammar— DCG). Важливою проблемою при розумінні природної мови є її неоднозначність. Більшість висловлювань може приймати декілька значень, вірне з яких, на даний момент, лише одне. Відкинення неоднозначності виконується на основі знань про світ і сучасну ситуацію у ньому.

Не дивлячись на те, що такі сучасні системи генерування мови як Parry? NET talk та інші досить добре можуть імітувати природній діалог з людиною, вони, все ж, не можуть обманювати співрозмовника дуже довго. Їх проблема полягає не у пам’яті, не у здатності генерувати вагомі речення, а у недостатньому розумінні машинами мови, що вони використовують. Комп’ютерний аналіз складних взаємовідносин у середині мови призвів до створення досить складних програм, що здатні розуміти мову. Прекрасним прикладом для цього може слугувати перекладач Google.

Навчання машин. Навчання на основі спостережень

Научіння – одна з найнеобхідніших якостей людини, без якої ми не тільки не розвинулися до сучасного стану, але і просто вимерли б як вид. Зрозуміло, що одним з перспективних напрямків вивчення штучного інтелекту є проблема научіння машин. Якщо вдасться створити такий комп’ютер, що буде здатен сам себе вчити, то відпаде необхідність створення нових програм для засвоєння ним нових можливостей. Проблема научіння лежить в аспекті використання сприйнятої інформації не тільки для виконання дій, а і для підвищення здібностей машини. Існує кілька видів научіння.

Научіння, що контролюється базується на вивченні деякої функції на її вхідних та вихідних даних. Правильне вихідне значення може задаватися учителем або з власних спостережень комп’ютера. Якщо машина може спостерігати за своїми діями, то не виникає проблем з використанням методу контрольованого научіння. У інших випадках, тобто якщо результати дій не повністю доступні для сприйняття, зазвичай використовується спосіб неконтрольованого научіння. Цей метод використовується коли комп’єютер не може визначити правильність чи неправильність вихідного значення функції, він базується на імовірнісних обрахунках. Найбільш загальною з цих категорій є задача научіння з підкріпленням. Такий спосіб научіння не потребує вказівок учителя, а працює завдяки підкріпленням.

Іншим важливим аспектом в навчанні машин є наявність початкових знань. У процесі навчання, людина отримує безліч побічних знань, що дозволяє краще накласти новий матеріал на вже існуючий. Також і для штучного інтелекту, значно продуктивнішим є навчання, що накладається на деякий вже існуючий багаж знань.

Індуктивне навчання.

Будь – який алгоритм навчання включає в себе задачу відновлення функції, що призвела до правильного результату або побудови іншої функції, близької до неї. Функція, яку генерує комп‘ютер називається гіпотезою. Якісна гіпотеза має правильно передрікати появу ще не отриманих результатів, в цьому і постає фундаментальна проблема індукції.

З самого початку не можливо визначити, чи можливо знайти таку гіпотезу. Можливість знаходження гіпотези залежить від обраного простору гіпотез. Прийнято вважати, що задачу навчання можливо реалізувати, якщо простір гіпотез містить необхідну функцію, і що її реалізувати неможливо, якщо простір гіпотез такої функції не містить.

Навчання ансамблю

На відміну від індуктивного навчання, цей метод постоїть у тому, що з простору слід обирати цілий набір гіпотез. Потім проводиться комбінування передбачень на їх основі і голосування для визначення найкращої класифікації нового прикладу. Причина переваги такого методу полягає у меншій вірогідності обрання неправильної класифікації прикладу, адже на відміну від попереднього способу, де висновок робився на результаті однієї гіпотези, при обранні ансамблю гіпотез (наприклад їх кількість - 5), для обрання хибної класифікації помилку повинні зробити щонайменше 3 з 5 відібраних гіпотез.

Також побудова ансамблю гіпотез допомагає у побудові нових просторів гіпотез, що сформовані з гіпотез першопочаткового простору. Такий підхід призводить до побудови більш виразних просторів гіпотез.

Теорія обчислювального навчання

Вище було поставлене важливе питання, відповідь на яке поки що не давалася. Як саме можна впевнитися, що в результаті алгоритму навчання було створено теорія, що дозволяє правильно прогнозувати майбутнє? А точніше – наскільки відтворена функція відповідає початковій. Пояснення того, що алгоритми навчання працюють лежить у теорії обчислювального навчання, у основі якого лежить принцип, що говорить: «Будь-яка гіпотеза, що містить серйозні помилки, буде «відкрита» с великою імовірністю після обробки невеликої кількості прикладів, оскільки вона виносить неправильні передбачення. Тому будь-яка гіпотеза, що співставлень з достатньо великою кількістю прикладів під час навчання, з низькою імовірністю буде містити серйозні помилки; це означає, що вона обов’язково буде приблизно правильно. З визначеною імовірністю» (Artificial Intelligence: A Modern Approach, Russel and Norvig)

Використання знань у навчанні

Також слід окреслити проблему використання початково наданих, або вже здобутих знань машиною у подальшому процесі навчання. Апріорні знання можуть допомагати у навчанні, відмітаючи хибні гіпотези, які, за обставин відсутності таких знань, класифікувалися б як спів ставні. Успішне використання апріорних знань у процесі навчання доводить, що ще більш перспективним є кумулятивне навчання, тобто таке, в якому комп’ютер підвищує свою здатність до навчання з набуттям більшої кількості знань. У метода навчання на основі пояснення (Explanation-Based Learning — EBL) передбачається витягнення загальних правил з конкретних прикладів і узагальнення пояснень. Такий дедуктивний метод дозволяє перетворювати знання основних принципів у корисні, ефективні знання спеціального значення.

«Машинна творчість»

Одною з найперспективніших галузей в області штучного інтелекту є штучна творчість. Творчість як феномен ще дуже мало вивчений у людини, це велике поле для сучасних психологів. Але на даному етапі існування штучного інтелекту вже можливе моделювання творчого процесу, і можливо саме це моделювання зможе допмогти нам у вивченні людської творчості.

Ось декілька прикладів комп’ютерних витворів мистецтва.(Соло, Когнитивная психология)

Поезія.

Програма RKCP моделює мову, засновуючись на матеріалах, що «читала». Наприклад вона написала хоку після читання віршів Джонса Кітса і Уенді Денніс.

Душа

Ты разбил мне душу,

сок вечности,

дух моих губ.

Музика.

На даний момент машини дуже успішно справляються з задачею створення музикальних тем на основі вже існуючих творів. Слабке місце таких програм – те, що довго вони не можуть довго обманювати спеціалістів, що знаються на стилях музики.

Зображувальне мистецтво.

Існують програми, що значно полегшують дизайнерам роботу, але вони значно відрізняються від тих, що створюють картини. Прикладом може стати робот Аарон, що створив картини, що нагадують справжній живопис.

У всіх приведених вище прикладах критерієм оцінки стає судження людей. Якщо на їх думку витвір достатньо схожі на людську роботу, то він гідний високої естетичної оцінки. Нам не вистачає об’єктивних критеріїв у творчості, і поки ми не визначимо їх більш чітко, вона лишиться у руках людей окремих обчислювальних машин.

Процес творчості

Одним з важливих моментів і процесі творчості є перенос (транспонування) структур з однієї ситуації в іншу. Проблема транспонування однією з найважливіших у психології мислення і сприйняття, що, як відомо, тісно пов’язані. Неможливість спостерігати процесів мислення, під час яких відбувається перенос ідей з різних областей знань, призводить до труднощів у вирішенні цієї проблеми.

Однією з характеристик сприйняття є його структурність. Структура, як носій деякого образу, може бути перенесена в нові умови без змін. Тоді буде утворено новий об’єкт, що зберігатиме початкові характеристики. Тому при дослідженні такого образу відчувається безпосередній зв’язок з початковою структурою. По пояснюється наявністю інваріантів перетворення. Наявність інваріантів іноді маскуються трансформантами, тобто елементами, що змінюються, вони часто настільки змінюють ситуацію, що впізнати інваріанти майже неможливо.

Для проблеми штучного інтелекту безпосереднє значення має дослідження закономірностей переносу інваріантів структури. Задача штучного інтелекту – отримувати такі результати, які зазвичай отримуються в результаті людської творчої діяльності не залежно від того, імітується творчий процес людини чи ні. У 1972 році Міжнародною фіршбурзькою групою був складений список задач, що стосуються штучного інтелекту. Другим пунктом у цьому списку ставала машинна творчість в області музики, поезії, живопису. Вже описана вище проблема машин у розумінні природної мові тісно пов’язана з проблемою виділення структурних інваріантів. Один смисл може бути виражений різними словами, тому ця проблема також торкається вивчення закономірностей варіювання деяких ситуацій, що зберігають інваріант – смисл. Таким чином, дана проблема тісно пов’язана з психологією творчості і дослідженнями творчого процесу а також кібернетикою і проблемою розуміння машинами мови.

Основним сучасним методом вивчення транспортування є метод моделювання, що розроблений Захриповим для дослідження деяких функцій композитора і музикознавця. Цей метод полягає у штучному відтворенні властивостей і якостей об’єкта. Аналіз машинних результатів дозволяє оцінити вірність гіпотез і ступінь вивченості об’єкту.

Не звертаючи уваги на популярність і розвиненість теми машинної творчості, багато хто вважає, що такі явища як інтуїція, інсайт, не піддаються алгоритмізації, на основі якої і побудовані сучасні обчислювальні машини. Також існує думка (Захрипов, Моделювання творчості), що творчість частково складається з логічних структур і задача полягає саме у їх вивченні. А варіювання, що також у деякій мірі включене в алгоритми машини створює деяку «свободу дій» і являється одним з суттєвих елементів творчого процесу. Інакше кажучи, Захрипов стверджує, що варіювання елементів складає основний принцип художньої творчості і, можливо, будь-якій творчості взагалі.

Критика штучного інтелекту.

У попередніх частинах роботи було розглянуто минуле і сучасне штучного інтелекту. Отже, що підвести логічний підсумок слід розглянути прогнози на його майбутнє. Велика кількість вчених, протягом останніх шести десяти років працювала над проблемою створення штучного інтелекту і, в ході своєї роботи, вони доходили деяких висновків щодо перспектив цієї галузі. Вчені різних галузей по різному ставилися до ідеї створення штучного інтелекту, тому я розглянула це питання з точки зору кібернетики і психології, двох основних наук у цій галузі.

Алан Т’юринг був одним з першопроходців в області штучного інтелекту, і він представив у своїй роботі одну з найоригінальніших ідей минулого століття: гру в імітації, або тест Т’юринга. Він запропонував визначати здатність машини до мислення шляхом перевірки, чи зможе вона впевнити свого співрозмовника у тому, що вона – людина. Цей підхід можна вважати вірним, якщо враховувати, що ми не в змозі спостерігати за процесами мислення і судимо про його наявність тільки з результатів, а отже і про наявність машинного мислення слід також судити виходячи з результатів. Також Т’юринг окреслює, що саме слід вважати за машин у такому випадку. Шляхом відсіву, він виділяє ЕОМ з-поміж усіх можливих варіантів (наприклад штучно створена людина) і пояснює деякі принципи їх роботи.