Реферат: Математические основы теории систем

ОГЛАВЛЕНИЕ

Оглавление 1

Введение 3

Объект и устройство 3

Задачи управления 4

Матричный формализм в теории систем 6

Линейные операторы 6

Инвариантное подпространство 6

Действия над векторами 8

Матрицы и линейные преобразования 10

Понятие матриц 10

Операции над матрицами 11

Транспонированная матрица 12

Теорема Гамильтона-Келли 13

Обратная матрица 13

Диагонализация матриц 13

Понятие динамического объекта 14

Уравнение вход-выход-состояние 15

Объекты управления с непрерывным временем 19

Способы вычисления матричной экспоненты 21

Весовая функция 24

Передаточные функции и их свойства 26

Объекты управления с дискретным временем 27

Решетчатые функции 28

Разностные уравнения 29

Структурные свойства объектов управления 33

Наблюдаемость 35

Характеристики управляемости 35

Сигналы в задачах управления и наблюдения

динамических объектов 36

Скачкообразная и переходная функции 38

Импульсная и весовая функции 39

Детерминированные стохастические сигналы и

системы 40

Модели случайных сигналов 42

Векторные (многомерные) случайные величины 42

Числовые характеристики (моменты) случайных

величин 43

Моменты многомерных случайных величин 46

Коварционная матрица 48

Элементы теории случайных функций 48

Линейные операции над случайными функциями 52

Стационарные случайные функции 55

Оптимизация в теории систем 55

Постановка задачи оптимального управления 56

Классификация задач оптимального управления 57

Динамически задачи оптимизации управления 59

Классическая задача оптимизации 61

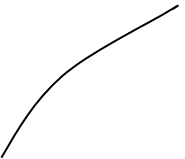

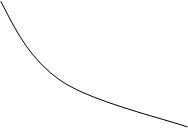

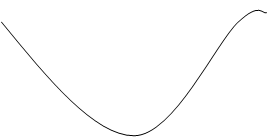

Выпуклые и вогнутые функции 61

Задачи нелинейного программирования 62

Метод штафных функций 62

Ограничения типа равенств неотрицательность

переменных 63

Квадратичное программирование 64

Итеративные методы поиска оптимума 64

Градиентный метод 64

Метод наискорейшего спуска (подъема) 64

Алгоритм Ньютона 65

Задачи и методы линейного программирования 65

Геометрическая интерпритация основной задачи

программирования 66

Симплекс метод 66

ВВЕДЕНИЕ.

Кибернетика - это наука об управлении, а также передаче и обработке информации в технических и нетехнических системах. Кибернетика возникла на базе техники и прежде всего техники регулирования, связи и машинной вычислительной техники, причем здесь нашли применение методы различных математических дисциплин, таких как теория функций, теория вероятности, статистика и математическая логика. Новым и можно сказать революционным моментом явилось то, что эти способы и математические методы, применявшиеся первоначально в технике, оказались удобными для анализа определенных явлений и достижения определенных целей в нетехнических системах и, прежде всего, и биологии и философии, экономики и общественных науках.

Теория автоматизации при предварительном определении понятия можно назвать кибернетикой. В автоматизированных процессах при автоматизации установок производственной техники, мы находим переплетение производственной и информационной техники.

Оно характеризуется тем, что на основании информации, получаемой путем измерения и затем перерабатываемой, оказывается воздействие на поток энергии или вещества таким образом, чтобы целенаправленно изменить определенные физические или технико-экономические параметры. Этот процесс называется управлением.

Управление - это целенаправленное воздействие на параметры или на отдельные системы и их поведение.

ОБЪЕКТ И УСТОЙСТВО.

Объект (объект управления) является частью данной установки, на которую оказывает управляющее воздействие и изменения которой являются определяющими для выполнения задачи управления.

СТРУКТУРНАЯ СХЕМА УПРВЛЕНИЯ

|

|

![]()

![]() Управляемый

Управляемый

![]() параметр

параметр

исполнительный сигнал

|

задающее

воздействие

поток информации

![]()

Рис. 1

Регулятором (управляющее устройство) называется совокупность звеньев, которые служат для оказания воздействия на объект через исполнительный орган в соответствии с поставленной задачей. Исполнительным органом называется звено, которое служит для непосредственного целенаправленного воздействия на поток энергии или вещества, он обычно относится к объекту. Звенья объекта и устройства управления называются элементарными звеньями. Временные характеристики входных и выходных параметров этих звеньев называются входными и выходными сигналами.

Входные сигналы, воздействующие на объект, называются сигналами помехи.

ЗАДАЧИ УПРАВЛЕНИЯ

Ранее мы охарактеризовали управление как целенаправленное воздействие на параметры процесса или системы. прежде чем осуществить такое целенаправленное воздействие, исследуем задачи.

Конкретная постановка задачи гласит.

1. Основные параметры процесса, несмотря на воздействие возмущения, должны стабилизироваться или изменяться согласно заданию.

2. Заданные параметры (температура, давление и т.д.) должны регулироваться так, чтобы обеспечивался удовлетворительный или оптимальный режим работы, чтобы желаемый выходной продукт производился в достаточном или в максимально возможном количестве, чтобы заданное количество выходного продукта имело минимальную себестоимость.

3. При изменении производственной задачи или условий протекания, процесс должен легко перестраиваться на другой режим работы. Например, пуск и остановка процесса загрузки, производственного или энергетического процесса при ремонте и т.д. Задача 2 требует построения только статической модели процесса и является статической проблемой, так что мы можем говорить об управлении в статическом режиме.

Задачи 2 и 3 касаются динамического режима, так как компенсация изменяющихся возмущающих воздействий, необходимая для стабилизации, сравнение параметров процесса с изменяющимся задающим воздействием, а также перестройка при переходе от одного режима в другой, могут быть решены только с учетом динамических характеристик процесса. Отсюда следует, что здесь идет речь об управлении в динамическом режиме.

В качестве основы для отыскания решения и оценки качества приложенной схемы управления используем количественную меру. Она выражается целевой функцией. При решении проблем 1 и 3 может быть использовано время T, в течении которого автоматическая система компенсирует скачкообразное возмущающие воздействие с точностью до заданной допустимой погрешности или в течении которого будет осуществляться процесс перехода в новое состояние. Время T при этом характеризует качество автоматического управления. При решении проблемы 1 можно использовать интеграл от абсолютной ошибки, представляющий разность между заданными и действительными значениями регулируемой величины в том случае можно говорить о функции ошибки.

В зависимости от того, что выражает целевая функция (качество или прибыль, ошибку или стоимость), цель к которой надо стремится, состоит в том, чтобы изменять регулируемые величины или свободные параметры в пределах допустимых или возможных границ так, чтобы целевая функция имела максимальное или минимальное значение. Таким образом, мы получим оптимальное управление. В других случаях, например, при отсутствии полных сведений о процессе или с целью снижения затрат на аппаратуру и вычислительные устройства, можно ограничиться субоптимальным, удовлетворяющим уравнением.

МАТРИЧНЫЙ ФОРМАЛИЗМ В ТЕОРИИ СИСТЕМ.

ЛИНЕИНЫЕ ОПЕРАТОРЫ.

Рассмотрим линейное n - мерное пространство Un. Пусть задано правило, которое ставит в соответствии произвольному вектору X пространства Un определенный вектор Y того же пространства. В этом случае вектор X называется прообразом, а вектор Y - образом вектора X. Это правило называется преобразованием пространства Un или оператором, заданном в пространстве Un.

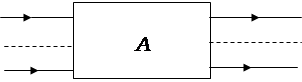

Преобразования (операторы) будем условно обозначать буквами А,В,С,... Например можно написать, что:

(1) АХ=Y

Равенство (1) читается так: преобразование (оператор) А, примененное к вектору Х, ставит ему в соответствие вектор Y.

Преобразование (оператор) называется линейным преобразованием (линейным оператором), если выполнено условие:

(2) A(Х+Y)=АХ+АY

(3) А(ℷХ)=ℷ(АХ), где ℷ- произвольное число

таким образом, линейное преобразование переводит сумму векторов в сумму их образов, а произведение вектора на число в произведение образа того вектора на это же число.

ИНВАРИАНТНОЕ ПОДПРСТРАНСТВО.

Пусть Х n - мерное линейное пространство и у=Ах -линейное преобразование на пространстве Х. Пусть X1∈X является некоторым подпространством Х, обладающим однако, тем свойством, что если х∈Х1, то и у=Ах∈Х1. Подпространство Х1, обладающее подобными свойством, называют инвариантным относительно линейного преобразования у=Ах.

Особенно интересны одномерные инвариантные пространства, представляющие собой прямые в пространстве Х, проходящем через начало координат.

Если х - произвольная точка пространства Х α - ве[ВЮЮ1] [ВЮЮ2] щественная переменная, меняющаяся от -∞ до +∞, то dx будет представлять собой одномерное подпространство Х, проходящее через х(при α =0), как показано на рисунке 2.

![]()

![]()

![]()

x2

x2

3

dx

![]()

2 x1

Такое одномерное подпространство будем обозначать R1. Предположим, что среди бесконечного множества одномерных пространств R1 найдутся такие, которые инвариантны относительно у=Ах, т.е. для любого x∈R1, имеет место у=Ах∈R1.

Обозначим через ℷ отношение у к х, которое при этом будет просто вещественным числом, т.е. можно записать у=ℷх, таким образом если R1 -инвариантное пространство, то для х∈R1 имеет место равенство:

(4) Ах=ℷх

Вектор х≠0, удовлетворяющий соотношению (4) называют собственным вектором матрицы А, а число ℷ - собственным значением матрицы А.

Для определения характеристических чисел матрицы перепишем соотношение (4) в ином виде, введя тождественное преобразование х=Iх. При этом получим:

(5) (А-ℷI)х=0

Соотношение (5) представляет собой систему линейных однородных уравнений, которая может быть записана в явном виде как:

![]() (a11-ℷ)x1+a12x2+...+a1nxn=0;

(a11-ℷ)x1+a12x2+...+a1nxn=0;

(6) a21x1+(a22-ℷ)x2+...+a2nxn=0;

.........................

an1 x1+an2x2+...+(a nn-ℷ)xn=0;

Матрица вида (А-ℷI) (6) называется характеристической матрицей А. Определитель характеристической матрицы называется характеристическим многочленом матрицы А. Корни характеристического многочлена матрицы называются характеристическими числами этой матрицы. Из свойств решения уравнения (6) нетривиальное решение (отличное от нуля) возникает только тогда, когда имеется бесчисленное множество решений:

(7) det(A-ℷI)+a0ℷn+a1ℷn-1+....+an-1ℷ=0

Подставив любое собственное значение в исходную систему уравнений (6), получим уравнение:

(8) (А-ℷiI)х=0

которое имеет непрерывное решение, так как det(A-ℷiI)=0

Это решение дает вектор хi, определяемый с точностью до скалярного множителя. Этот вектор называется собственным вектором матицы А.

Свойства:

1. Если собственные числа матрицы А различны (корни характеристического уравнения не равны), то порождаемые или собственные векторы образуют систему линейно независимых векторов.

2. Если матрица А симметрическая, то собственные числа такой матрицы всегда вещественны, а собственный вектор в матрице образует систему ортогональных векторов.

Линейные пространства, элементами которых являются, упорядоченные последовательности n-вешественных чисел называются векторами.

ДЕЙСТВИЯ НАД ВЕКТОРАМИ.

Упорядоченные последовательности из n - чисел х(1),...,х(n), могут быть записаны в виде вектор - столбца или вектор - строки;

![]()

x(1) n

n

x(1) n

n

(9) х= ..... = x)i) ; (x(1),...,x(n))=(x(i))

x(n) 1 1

Эти числа, составляющие вектор, называются компонентами вектора.

Если один из этих векторов обозначить буквой х, то другой будем обозначать х и называть транспонированным вектором.

n

(10) х=(х(i)) =(х(1),...,х(n))

1

Число n компонент вектора называется его размерностью.

СВОИСТВА ВЕКТОРОВ.

а) х=у, если равны их компоненты:

x(i)=y(i)

![]() x(1) y(1) x(1)+y(1)

x(1) y(1) x(1)+y(1)

б) х+у= ...... + ...... = ........... -сумма векторов.

x(n) y(n) x(n)+y(n)

в) Разность векторов х-у представляет собой вектор z, такой, что у+z=х.

г) умножение вектора на скаляр

x(1) αx(1)

x(1) αx(1)

αx[ВЮЮ3] =хα=α ....... = .........

x(n) αx(n)

СКАЛЯРНОЕ ПРИЗВЕДЕНИЕ ВЕКТОРОВ.

![]()

![]() x1 y1

x1 y1

Пусть х= х2 и у= у2 два вектора в трех мерном

x3 y3

пространстве. Скалярным произведением этих векторов называют скалярную величину:

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]() (11) хTу=уTх=х1у1+х2у2+х3у3

(11) хTу=уTх=х1у1+х2у2+х3у3

Нормой или длинной вектора х в евклидовом пространстве называют число:

(12) х = х =(хTх)½ , где х -норма вектора х.

Линейное пространство в котором определено скалярное произведение называется евклидовым пространством.

БАЗИС ЛИНЕЙНОГО ПРОСТРАНСТВА.

Пусть имеем систему векторов

(13) х1, х2, х3,..., хn

Базисом (базой) системы векторов (13) называется такая линейно-независимая ее подсистема, через которую линейно выражаются все указанные векторы.

УГОЛ МЕЖДУ ВЕКТОРАМИ. ОРТОГОНАЛЬНЫЕ ВЕКТОРЫ.

![]()

![]() Пусть х=(х1,

х2) и у=(у1, у2) - два вектора на плоскости.

Выберем систему координат так, чтобы ось абсцисс совпадала с направлением

вектора х, так что x1= x , х1 =0 (рис.3)

Пусть х=(х1,

х2) и у=(у1, у2) - два вектора на плоскости.

Выберем систему координат так, чтобы ось абсцисс совпадала с направлением

вектора х, так что x1= x , х1 =0 (рис.3)

![]() 2

2

![]()

![]()

y2 y

y2 y

![]() α

x

α

x

![]()

![]() y1 1

y1 1

![]()

![]()

![]()

![]() обозначим через угол α между

векторами х и у при этом

обозначим через угол α между

векторами х и у при этом

хTу=х1у1+х2у2= х * у cosα

Угол между векторами определяется:

![]()

![]()

![]()

![]() α=arccos(xTy/

x y )

α=arccos(xTy/

x y )

при │х│=1 скалярное произведение хTу определяет проекцию вектора у называется ортогональным, если угол между ними равен 90○, т.е.

если хTу=0.

МАТРИЦЫ И ЛИНЕЙНЫЕ ПРЕОБРАЗОВАНИЯ.

ПОНЯТИЕ МАТРИЦ.

Матрицей А размером m*n называют таблицу, содержащую m-строк и n-столбцов, элементами которой являются вещественные или комплексные числа

a11 .......... a1n

a11 .......... a1n

A= ...................... =[aij]

am1 .......... amn

Если m=n, то матрицу называют квадратной.

Матрицы А=[аij] и В=[вij] равны (А=В) в том и только в том случае, если имеют один и тот же размер аij=вij для всех ij.

Преобразованием линейного n-мерного пространства Х называют оператор А, отображающий это пространство в m - мерное линейное пространство Y:

(1) А:Х→Y

Таким образом, преобразование А ставит в соответствие каждому вектору х пространства Х вектор

(2) Y=А-х, пространства Y.

Преобразование А называют линейным, если выполняется условие:

(3) А(х1+х2)=Ах1+Ах2, А(ℷхi)=ℷАх

Условие (3) будет выполнятся, если между компонентами хi и уj векторов х и у имеется линейная зависимость вида:

n ___

(4) у(i)= ∑ aijx(j), i=1,m ,где аij - произвольное число

j=1 ____ ___

Совокупность чисел аij, i=1,m; ;j=1,n образуют матрицу:

a11......a1n

a11......a1n

A= ................ = [aij]

am1......amn

которую

называют матрицей линейного преобразования.

которую

называют матрицей линейного преобразования.

у=Ах можно записать в виде умножения матрицы на вектор:

y(1) a11......a1n x(1)

(5) .... = ............... * .....

y(n) am1......amn x(n)

ОПЕРАЦИИ НАД МАТРИЦАМИ. УМНОЖЕНИЕ МАТРИЦЫ НА ЧИСЛО.

Пусть А матрица линейного преобразования Ах, α- число.

(6) αА=[α аij ]

При умножении матрицы А на число α все ее члены умножаются на это число.

СУММА МАТРИЦ.

Пусть у=Ах и v=Вх - два линейных преобразования с матрицами А=[aij] и В=[вij] размером m*n.

Рассмотрим новое линейное преобразование, ставшее в соответствие каждому вектору х∈Х вектор у+v∈Y

(7) у+v=Ах+Вх=(А+В)х

Преобразование (А+В)х называют суммой линейных преобразований Ах и Вх, или:

(8) А+В=[aij]+[вij]

При сложении двух матриц одинакового размера получается новая матрица того же размера, элементы которой равны сумме элементов складываемых матриц.

ПРОИЗВЕДЕНИЕ МАТРИЦ.

Пусть X,Y,Z-линеиные пространства размерностью m, r, n и пусть у=Вх, z=Ау - линейные преобразования пространства Х в пространство Y, и пространства Y в пространство Z, где В=[вkj] и A=[aik] матрицы размером m*k и k*n соответственно. Произведением преобразований Ау и Вх называют новое линейное преобразование Сz.

(9) Z=Cx=A(Bx)=ABx

Матрицу С=АВ размером n*n называют произведением матриц А и В.

n ___ ___

(10) Сij= ∑ аikвkj , i=1,n , j=1,m

k=1

Согласно (10) элемент Сij матрицы С представляет собой скалярное произведение i-й строки матрицы А на j-й столбец матрицы В, так что произведение матриц АВ символически может быть представлено в виде:

a11...a1k

в11...в1m

a11...a1k

в11...в1m

(11) АВ= ............ * .............

an1...ank вk1....вkm

ТРАНСПОНИРОВАНАЯ МАТРИЦА.

Пусть А=[aij] - матрица размером m*n. Матрица АT=[а'ij] размером m*n, строки которой являются столбцами матрицы А, столбцы строками матрицы А.

Элемент а'ij матрицы АT определяют по элементам аij матрицы А из соотношения:

(12) а'ij=аji

ОСОБЕННОСТИ КВАДРАТНЫХ МАТРИЦ.

В квадратной матрице число строк равно числу столбцов.

Определителем квадратной матрицы называют, определитель составленный из элементов aij этой матрицы и обозначают det A.

Определитель det A обладает следующими свойствами:

1) при умножении на ℷ любого столбца матрицы А определитель det A умножается на ℷ;

2) перемена местами двух соседних столбцов меняет знак det A на противоположный;

3) если любые два столбца матрицы равны между собой, то det A=0;

4) добавление к любому столбцу матрицы любого другого столбца, умноженного на произвольный скалярный множитель, оставляет det A неизменным;

5) если столбцы матрицы линейно зависимы, то det A=0;

ТЕОРЕМА ГАМИЛЬТОНА-КЕЛЛИ.

Каждая квадратная матрица является корнем своего характеристического уравнения.

(13) det (A-ℷI)=a0ℷn+a1ℷn-1+...+an-1ℷ an=0

(14) a0An+a0An-1+an-1A+anI=0[n*n]

ОБРАТНАЯ МАТРИЦА.

Матрицей, обратной по отношению к квадратной матрице А размером n*n, назовем такую матрицу А-1 того же размера, для которой справедливо соотношение:

(15) А*А-1=А-1*А=Е

Пусть у=Ах - линейное преобразование с квадратной матрицей А=[xij]. Обратным преобразованием называют преобразование х=А-1у. Матрицу А-1 этого преобразования называют обратной по отношению к матрице А.

(16) А-1=(1/detA) [Aij]T , где Аij - алгебраическое

дополнение элемента а в определителе матрицы.

Система уравнений Ах=у называется определенной и имеет единственное решение, если detA≠0. Матрица А, для которой выполнено это условие, называют невырожденной.

ДИАГАНАЛИЗАЦИЯ МАТРИЦ.

Вид квадратной матрицы А линейного преобразования у=Ах, может быть изменен без изменения характеристического уравнения этой матрицы путем использования преобразования подобия.

Пусть А - квадратная матрица; С - произвольная невырожденная матрица. Преобразованием подобия называют преобразование:

(17) В=С-1*А*С

Преобразование подобия позволяет приводить некоторые виды квадратных матриц к диагональной форме, являющейся наиболее удобным видом матрицы.

ℷ1

0 0

ℷ1

0 0

(18) diag[ℷ1 ℷ2 ......ℷn ]= 0 ℷ2 0

0 0 ℷn

Нормой матрицы А размер m*n называется сумма модулей ее элементов:

m n

(19) │А│= ∑ ∑ │a ij │

i=1 j=1

При решении задач удобно ввести матрицы, элементы которых являются функциями независимой переменной t.

Эти матрицы имеют вид:

a11(t) a12(t) ...... a1n(t)

a11(t) a12(t) ...... a1n(t)

(20) А(t)= a21(t) a22(t) ...... a2n(t)

............................

am1(t) am2(t) ..... amn(t)

и называются функциональными матрицами.

Производной матрицы А(t) по независимому переменному называется матрица А(t) вида:

da11(t)/dt da12(t)/dt ...... da1n(t)/dt

(21) А(t)= dA(t)/dt = ............................................................. =

dam1(t)/dt adm2(t)/dt ...... damn(t)/dt

=[daij(t)/dt]

1.3 ПОНЯТИЕ ДИНАМЧЕСКОГО ОБЬЕКТА.

Физический объект - физическое устройство, характеризуемое некоторым числом свойств, соответствующих целям его использования.

В теории систем существенным является не физическое, а математическое описание свойств объекта и соотношений между ними. В теории систем объектом А является абстрактный объект, связанный с множеством свойств, который обычно характеризуется числами или набором чисел. Таким образом, фактически абстрактный объект или просто объект представляет собой множество переменных вместе с отношениями между ними.

Вспомогательные определения и понятия:

v1, v2,...- основные переменные объекта А.

Основное уравнение - соотношение между основными переменными.

(1) A(1)(v1,..., vn)=0 Основное уравнение объекта A,

A(2)(v1,...., vn)=0 где A(j), j=1,..., m

..................... vi , i= 1,..., n

A(m)(v1,..., vn)=0 m и n - конечные числа

Если абстрактный объект A определяется соотношениями (1) без каких - либо указаний, какие переменные являются входными (причина), а какие - выходными (следствия), то A будем называть неориентированным объектом.

Если основные переменные подразделены на две группы - входные и выходные переменные, играющие роль независимых и зависимых, то A будет называться ориентированным объектом.

Состояние объекта A в момент t0 может рассматриваться как параметр S(t0), связанной с каждой парой вход-выход

(U[t0, t], Y[t0, t]), таким образом, что Y[t0, t] единственным образом определяется заданием U[t, t] и S(t0).

Иначе говоря, состояние объекта в момент t0 есть некоторый набор чисел, представленный, например, вектором α, который изменяется в пространстве ∑ так, что знание (1)α, (2) - уравнения вход-выход для объекта и (3) - входа U[t0,t]] является достаточным для однозначного определения входа y[t0,t].

S(t0) - называется состоянием объекта в момент t0.

[t0,t]- интервал наблюдаемости

УРАВНЕНИЕ ВХОД-ВЫХОД-СОСТОЯНИЕ.

Пусть А- ориентированный абстрактный объект, U,у - вход и выход на интервале наблюдения [t0,t] - переменная в пространстве ∑, R[U], R[y]- пространство входа и выхода.

(2) y(t)=A (α;U[t0,t]) ∀ t>t0

где A- функция α и U[t0,t]

U и у принадлежат R[U], R[у]

Уравнение (2) является уравнением вход-выход состояния. Символьная форма записи вход - выход - состояние.

(2') у[t0,t]=A (α,U), где

черта над A служит для того, чтобы отличить у(t) и у[t0,t]

Следовательно пара U[t0,t],у[t0,t] удовлетворяет уравнению

вход - выход - состояние (2), если U[t0,t] и у[t0,t] составляют

пару вход-выход по отношению к некоторому α в ∑.

В соответствии с уравнением (2') можем записать:

R[y]= { A(α,U)│ α∈∑, U∈ R[U] }

Условия взаимной совместимости:

Каждая пара вход-выход для удовлетворяет уравнению вход - выход-состояние (2')

Более детально: (1) если (U[t0,t],у[t0,t]), или проще (U,у) является любой парой функции времени (при U∈R[U], у∈R[y]),

удовлетворяющих уравнению А(U,y)=0, то (U,y) удовлетворяет также и (2') в том смысле, что существует α0 в ∑ такое, что

(3) у= A (α0,U[t0,t]),

и (2) любая функция времени (U,y), удовлетворяющая уравнению (2') для некоторого α, принадлежащего ∑ на интервале наблюдения [t0,t], является парой вход-выход для A.

Первое условие собственной совместимости:

Для того, чтобы множество ∑ могло называться пространством состояний A , оно должно иметь следующее свойство: если дана любая точка α в ∑ (которую мы назовем состоянием A в момент t0) и любой вход U[t0,t] в пространстве входов A, то выход в момент t однозначно определяется значением α и U[t0,t], и не зависит от значений U и y в момент времени, предшествующий t0, т.е. для всех t0 реакция y(t) в любой момент времени t>t0, однозначно определяется заданием α и U[t0,t].

Это свойство является ключевым в понятии состояния. Второе условие собственной совместимости.

Если уравнения вход - выход-состояние удовлетворяется при подстановке пары (U[t0,t],у[t0,t]), тогда оно удовлетворяется при подстановке всех пар вида (U[t,t1], у[t,t1]), где t0<t≤t1, а U[t,t1] и у[t,t1] являются сегментами U[t0,t], и у[t0,t] соответственно. Это должно выполняться для всех α и ∑ и всех пар вход-выход, относящихся к α.

Пусть (UU',yy') - пара вход-выход, удовлетворяющая уравнению вход - выход-состояние (2') при α=α0. Тогда можно записать: yy'= A (α0,UU'), где U',y' вход и выход на интервале [t,t0]

Утверждение, что (U',y') удовлетворяет уравнению вход - выход-состояние (2'), будет эквивалентно утверждению, что существует не пустое множество Q значений α в ∑, при которых выражение y=A(α;U') удовлетворяется для всех α в Q.

Тогда в качестве состояния объекта A в момент t может быть принято любое состояние α в Qt (α0,U) при α0-состояние в момент t0 или, что тоже самое, начальном состоянии A.

Состояние A в момент времени t будет обозначаться S(t).

Когда будет необходимо показать, что S(t0) является начальным состоянием объекта A, уравнение вход - выход-состояние будет записываться в виде:

(4) y(t)= A(S(t0);U[t0,t])

S(t0) и, в более общем случае S(t) изменяются в пространстве состояний ∑, т.е. для каждого фиксированного значения t, R[S(t)]=∑.

Если выполнены условия совместимости, то можно утверждать, что состояние S(t) однозначно определяется состоянием S(t0) и входом U[t0,t] и что функциональная зависимость S(t) от S(t0) и U[t0,t] может быть получена из уравнения вход - выход-состояние:

y(t)= A( S(t0); U[t0,t]), где α0=S(t0) (4)

Выражение S(t) как функция S(t0) и U[t0,t] называется уравнением состояния объекта.

(5) S(t)= S (S(t0);U[t0,t]), где

S- функция со значением в ∑.

Уравнение (5) производное от уравнения вход - выход-состояние (4).

Природа пространства состояний ∑ объекта является одной наиболее важных его характеристик. Если ∑ есть континуум, то будем говорить, что А есть объект с непрерывным пространством состояний.

Если ∑ есть счетное множество, A будет называться объектом с дискретным пространством состояний.

Если ∑ есть конечное множество, то А есть объект с конечным пространством состояний.

Вероятностные или стохастические объекты- объекты в которых для каждого t y(t) является случайной переменной. Для таких объектов уравнения вход-выход- состояние (4), заменяется уравнением вход-выход- распределение состояний, которое определяет вероятностную меру в пространстве y[t0,t] как функцию начального состояния S(t0) и входа U[t0,t] .

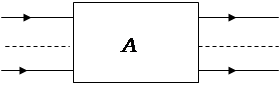

Графическое представление систем.

![]()

U1 у1 U1 S у1

|

|

||

Uк ук Uк ук

Представление объекта в виде блок-диаграмм

1.4 ОБЪЕКТЫ УПРАВЛЕНИЯ С НЕПРЕРЫВНЫМ

ВРЕМЕНЕМ.

Дифференциальные уравнения состояния:

(1) Ś(t)= A(t)S(t)+B(t)U(t)

(2) у(t)= C(t)S(t)+D0(t)U(t)+D1(t)U(1)(t)+...+Dк(t)U(к)(t)

Коэффициенты этих уравнений являются матрицами.

A- матрица состояний [n*n]

B- матрица входа [m*n]

C- матрица выхода [L*m]

D- проходная матрица [L*m]

Пусть А- непрерывная система, заданная уравнением входа-выхода вида:

Lу+Kŷ=Mu, где L,K,M- матричные дифференциальные операторы с постоянными коэффициентами, u,у - входной и выходной векторы, а ŷ -скрытый выходной вектор.

Соотношения вход - выход-состояние.

В процессе установления соответствия вектора состояния с системой и связанного с этим определения соотношения вход - выход-состояние системы, описываемой дифференциальными уравнениями, состоит в нахождении общего решения этого дифференциального уравнения.

(2) L(p)y=u, L(p)=anpn+...+a0, an≠0, которое описывает R.

Решить дифференциальное уравнение можно с помощью методов, хорошо известных из теории обыкновенных дифференциальных уравнений. Однако будет удобно основываться не на классической теории, а получить общее решение сразу, путем преобразования Лаплпса.

Пусть R- система, описываемая соотношением вход-выход (2), тогда выражение для общего решения будет иметь вид:

n t

(3) y(t)= ∑ y(ℷ-1)(t0-)Фℷ(t-t0)+ ⌡ h(t-ℰ)U(ℰ)dℰ t≥t0,

ℷ=1 t0

где h(t)=Z {1/L(S)}= импульсной реакции R

(4) H(S)=1/L(S)= передаточная функция R,

Фℷ=Z-1{(anSn-ℷ+...+aℷ)/L(S)}, ℷ=1,...,n

Функции времени Ф1,...,Фn линейно независимы и удовлетворяют дифференциальному уравнению

L(p)Фℷ(t)=0, ℷ=1,...,n

На втором этапе необходимо отождествить постоянные ai, i=1,..,n из уравнения (2) с составляющими вектора x(t0-) - состояние R в момент времени t0-.

Положим базисные функции, или точнее говоря их преобразования по Лаплпсу, равными:

Sn-1/L(S),...,S/L(S),1/L(S)

В этом случае составляющим x(t0) будет:

(5) x1(t0-)=any(t0-),

x2(t0-)=any(n-1)(t0-)+a1y(t0-)

....................................................

xn(t0-)=any(n-1)(t0-)+...+an-1y(t0-)

Заменяя начальные значения y(ℷ-1)(t0-) в (3) через их выражения, представленные с помощью составляющих x(t0-), получим для общего решения (3)

t

(6) y(t)=<(t-t0),...,x(t0-)>+ ⌡ h(t-ℰ)U(ℰ)dℰ, t≥t0

t0

где h- импульсная реакция R

Ф(t)=(Ф1(t),...,Фn(t)); составляющие которого суть базисные функции:

Фℷ(t)= Z-1{ (anℷn-1+...+ aℷ)/L(S) },

а <Ф(t-t0), x(t0-)> обозначает скалярное произведение базисного

вектора Ф(t-t0) и начального вектора состояния x(t0-).

Уравнение (6) является соотношением вход - выход-состояние для R.

ФУНДАМЕНТАЛЬНАЯ МАТРИЦА.

Будем исследовать реакцию при нулевом входе и вынужденную реакцию систем, описываемых уравнением вида:

(11) x(t)= A(t)x(t)+B(t)U(t), где

A(t)- квадратная матрица порядка n, элементами которой являются функции, непрерывные для всех значений t; B(t)-непрерывная матрица размером [n*r]; x(t) - вектор состояния, U- вход.

Пусть A(t) есть квадратная матрица порядка n, элементы которой - непрерывные функции. Тогда решение матричного дифференциального уравнения:

(12) X= A(t)X(t), X(t0)=C, где

C есть произвольная постоянная матрица, имеет следующий вид:

(13) X(t)= (t,t0)C

Любая неособенная матрица, которая удовлетворяет матричному дифференциальному уравнению (12), называется фундаментальной матрицей системы (11). Таким образом, любая фундаментальная матрица имеет вид (13) при некоторой неособенной матрице С n строк любой фундаментальной матрицы есть n линейно независимых решений для уравнения (11).

th. Пусть A(t) есть квадратная матрица порядка n, элементы которой непрерывные функции времени. Пусть Ф(t,t0) есть также квадратная матрица порядка n, которая является решением уравнения

(14) d/dt Ф(t,t0)=A(t)Ф(t,t0), (t,t0)=I

Тогда решение уравнения

(15) x(t)= A(t)x(t), x(t0)=x0,

обозначаемое через x(t,x0,t0), есть

(16) x(t,x0,t0)=Ф(t,t0)x0 ∀t, ∀x0

Матрица Ф(t,t0) называется переходной матрицей состояния.

Из уравнения (16) можно сказать: матрица Ф(t,t0) есть

линейное преобразование, которое отображает состояние x0 в момент времени t0 в состояние x(t) в момент t.

СПОСОБЫ ВЫЧЕСЛЕНИЯ МАТРИЧНОЙ ЭКСПОНЕНТЫ.

t

1. Если всех t ⌡ A(Ʈ)dƮ и A(t) коммутативны, то

t0

t

t

Ф(t,t0)= exp ⌡ A(Ʈ) dƮ

t0

Пусть Ф(t,t0) переходная матрица для (11),определяемой выражением (14), тогда:

t

t

(17) det Ф(t,t0)= exp ⌡ a(Ʈ) dƮ , где

t0

n

a(Ʈ) ≜ ∑ aiƮ(Ʈ) ≜ trA(Ʈ).

i=1

2. Законченное решение позволяет получить формула интерполяции Лагранжа-Сильвестра. Она применима к матричным функциям, которые могут быть представлены в виде (сходящихся) степенных рядов.

∞

f(A)= ∑ CiAi ,где

0

матрица А с n отличающимися друг от друга собственными значениями соответствующих формуле интерполяции Лагранжа для аппроксимации функций с помощью многочленов. Матрица перехода Ф=exp{At} представляет такой степенной ряд

n

(18) Ф(t)= eAt= ∑ eℷitFi , где

i=1

n

F=П (A-ℷiI)/(ℷi-ℷj)

j=1

j≠i

3. Применение преобразования Лапласа к однородному дифференциальному уравнению вида q=Aq, позволяет получить формулу, похожую на формулу Сильвестра, которую можно использовать не только для случая с простыми корнями.

∞

(19) Ф(t)= eAt≜ ∑ Aiti/i!= I+At+A2t2/2!+...

i=1

Эта формула особенно пригодна для аналитических исследований.

4. С помощью преобразования подобия матрица с n совершенно различными корнями ℷi может быть приведена к диагональной матрице Л.

Решение относительно А дает.

(20) A= KЛK-1 ,где

К - матрица собственных векторов, K≜[K1,K2,...,Kn], согласно выводу из теории матриц имеет:

для двух подобных матриц А и, Л соответствующих уравнению (20), справедливо

f(A)=Kf(Л)K-1

(21) Ф(t)=KeЛtK-1

причем, если известны корни ℷi, сразу можно записать матрицу exp{Лt}

eℷ1t......0

eℷ1t......0

eЛt=

0......eℷnt

Рассмотренные способы дают решение в аналитическом виде и требуют больших затрат времени на определение собственных значений матрицы А, т.е. корней характеристического уравнения. В приведенных ниже способах оба этих момента отсутствуют.

5 При расчете матрицы перехода с помощью формулы Тейлора из (19)

p-1

(22) Ф(t)= ∑ Ai ti/t!+Rp

i=0

в системах с сосредоточенными параметрами для отдельных элементов матриц получим полиномы в функции t, которые могут быть записаны в виде сумм показательных функций e.

6. Путем программирование на аналоговой вычислительной машине элементы матрицы перехода могут быть получены в виде кривых, численно оценены или аналитически аппроксимированы.

Модуль вход-выход непрерывного объекта управления в форме векторно-матричного дифференциального уравнения

вектор входа U=[U1, U2,...,Um]T

вектор выхода x=[x1,x2,...,xm]T

вектор состояния q=[q1,q2,...,qm]T

Уравнение состояния (векторное дифференциальное уравнение)

(23) q(t)= Aq(t)+Bu(t)

Уравнение входа

(24) x(t)= Cq(t)+Du(t)

Для одномерной системы n-го порядка эти уравнения упрощаются:

(25) q(t)=Aq(t)+bu(t)

(26) x(t)=CTq(t)+du(t)

![]()

![]()

![]() (27) q1

= a11 a12 q1 + b1 U; при

n=2

(27) q1

= a11 a12 q1 + b1 U; при

n=2

q2 a21 a22 q2 b2

![]() (28) x=|C1 С2|

q1 +

dU

(28) x=|C1 С2|

q1 +

dU

q2

Таким образом, векторное дифференциальное уравнение (25) служит компактной формой записи для системы из n скалярных дифференциальных уравнений первого порядка

(29) q = a11q1+a12q2+b1U;

q = a21q1+a22q2+b2U.

Уравнение входа для одномерной системы представляет собой скалярное алгебраическое уравнение

(30) x= c1q1+c2q2+dU

ВЕСОВАЯ ФУНКЦИЯ.

Прежде всего нужно определить выходной сигнал xv(t), соответствующий входному сигналу Uv(t)

(31) Uv(t)=U(V)dV δ(t-V)

U(V)dV - площадь импульса

δ(t-V)- единичный импульс при t=V

Соответствующий этому выходной сигнал представляет реакцию на импульсное воздействие, или соответственно весовую функцию g(t-V), характеризуемую импульсами площадью U(V)d .

Если уравнения системы представлены в стандартной форме записи (23), (24), то можно использовать общую форму решения уравнения переходного процесса:

t

(32) q(t)= Ф(t)q(0)= ⌡ Ф(t-Ʈ) BU(Ʈ)dƮ= qсв(t)+qпрн(t)

0

В рассматриваемом здесь случае переходного процесса при

возмущающем воздействии и нулевых начальных условиях для выраженного в относительных единицах входного сигнала Uδ

Uδ(t)=δ(t)

получим характеристику состояния в относительных

t

(33) qδ(t)= ⌡ Ф(t-Ʈ) bδ(Ʈ) dƮ

0

Для импульса δ(Ʈ), возникающего в момент времени Ʈ=0, интервал интегрирования должен быть принят от -0

![]() Ф(t)b , при t≥0

Ф(t)b , при t≥0

(34) qδ(t)=

0, при t<0

Весовую функцию находят путем подстановки (34) в уравнение выхода (26)

(35) q(t)=xδ(t)=CTqδ(t)+dUδ(t)= CTФ(t)b+dδ(t) при t≥0

Для определения элементарного выходного сигнала xδ(t), соответствующего уравнению (31), нужно учесть еще смещение входного импульса по времени и его интенсивность (площадь).

(36) xv(t)=U(V) dV g(t-V)=U(V) dV[CTФ(t-V)b+dδ(t-V)]

![]()

![]()

![]()

U(t)=U(V)dV

δ(t-V)

U(t)=U(V)dV

δ(t-V)

U

![]() x(t)=U(V)dVq(t-V)

x(t)=U(V)dVq(t-V)

![]()

![]()

![]() V

Ʈ=t-V

V

Ʈ=t-V

![]() t

t

Элементарный входной и выходной сигналы при разложении на импульсы.

ПЕРЕДАТОЧНЫЕ ФУНКЦИИ И ИХ СВОЙСТВА.

Пусть система A линейна и стационарна и пусть h(*) является ее импульсной реакцией.

Предположим, что существует преобразование Лапласа для h. Тогда это преобразование

∞

(37) H(S) ≜ ⌡ e-st h(t) dt

-∞

называется передаточной функцией H системы A.

Передаточная функция является оператором, характеризующим передачу сигнала линейным передаточным звеном, путем умножения которого, на изображении входного сигнала получается преобразованный

входной сигнал звена, имевшего до этого рабочую точку q=0.

В случае системы со многими входами и выходами передаточная функция становится матричной передаточной функцией H(S);

ее (i,j)- представляет собой преобразование Лапласа для hij(t), т.е. для установившегося режима i-го выхода на единичный импульс, приложенный к j-му входу в момент t=0.

Пусть - линейная стационарная система, и пусть H(S)- ее передаточная функция. Если y является реакцией системы при нулевом состоянии на входе воздействия U, то

(38) Y(S)= H(S) V(S)

где Y и V - преобразования Лапласа для y и U.

Передаточная функция H(S) идентична весовой функции g(t), преобразованной по Лапласу.

1.5 ОБЪЕКТЫ УПРАВЛЕНИЯ С ДИСКРЕТНЫМ ВРЕМЕНЕМ.

В случае, когда одна или более переменных могут наблюдаться только периодически, причем период наблюдения достаточно мал, так то все переменные можно восстановить с приемлемой точностью по их квантованным значениям, можно записать уравнения рассматриваемой

системы для дискретных (квантованных) значений для всех переменных. Иными, словами в качестве такой системы берется дискретная по времени система.

Исследование дискретных систем во многом подобно исследованию непрерывных систем.

Преобразование непрерывных систем в дискретные.

Пусть дана непрерывная система Y с уравнениями состояния

(1) x= Ax + Bu;

(2) y= Cx + Du, где

A,B,C,D суть (n*n), (n*r), (p*n) и (p*r)- постоянные матрицы

соответственно.

Предположим, что компоненты входного вектора замеряются периодически и фиксируются (сохраняются неизменными) в течении каждого интервала (kT,(k+1)T), где k=...,-1,0,1...

|

|

||||

U y

рис.1

На рисунке 1 показано, что такая операция над входным вектором реализуется с помощью блока квантования, включенного между входом U и системой Y.

Если α(t) является входом блока квантования, то его выход α0 будет ступенчатой функцией

α0(t)=α(kT), kT<t≤(k+1)T

Будем полагать, что вход измеряется через каждые T секунд, где T- период повторения или период квантования. Вход системы задается последовательностью векторов {Uk}, причем Uk=U(kT+).

Период повторения T выбирается достаточно малым, так что интерполирование последовательностей {xk}, {yk}, где xk= x(kT+), yk= y(kT+), определяет функции x(t), y(t) с приемлемой точностью для всех t. По этой причине имеет

смысл искать зависимости между последовательностями {xk},{yk} и входной последовательностью. Наиболее удобно представить такие последовательности в виде рекуррентных соотношений выражающих xk+1 и yk+1 через xk и Uk . Используя выведенные ранее уравнения и вводя обозначение:

(3) F=exp AT,

T

(4) G=( ⌡ [exp(AƮ)]dƮ)B, получим

0

получим

(5) xk+1= Fxk+Cuk

(6) yk+1= Cxk+1+Duk+1

Выражения (5),(6) являются уравнениями состояния дискретной системы, вход, выход и состояние которой определяется последовательностями векторов {uk}, {xk}, {yk} соответственно. Поскольку A,B,C,D постоянные матрицы, эта система линейна и стационарна.

Из (5) можно найти xk как функцию начального состояния x0 и последовательности {Ui}r-1

k-1

(7) xk=Fkx0+ ∑ FiGUk-i-1, k=1,2,3,...

i=0

РЕШЕТЧАТЫЕ ФУНКЦИИ.

Функции, определенные только в некоторых точках t1,t2 и т.д называются решетчатыми.

Пусть t= nT- равностоящие точки, где n- любое целое число, а T- постоянная, называемая периодом дискретности.

Тогда определенные в этих точка функции f[nT]

f[nT]

![]() Любой f(t)- непрерывной можно

Любой f(t)- непрерывной можно

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]() поставить в соответствие

некоторое множество решетчатых функций, если представить переменную

t=nT+ℰT (0≤ℰ≤1). При

каждом фиксированном значении р переменной функцию f(nT+ℰT)

поставить в соответствие

некоторое множество решетчатых функций, если представить переменную

t=nT+ℰT (0≤ℰ≤1). При

каждом фиксированном значении р переменной функцию f(nT+ℰT)

-4T -3T -2T -T 0 T 2T 3T 4T nT

можно рассматривать как функцию, определенную в точках ℰT, (ℰ+1)T, (ℰ+2)T,....Такие функции называются смешанными решетчатыми функциями. f(nT+ℰT)=f[nT,ℰT]

(8) f (n-1)T,T = f[nT,0]

Конечные разности решетчатых функций.

Выражение Δf[n]=f[n+1]-f[n] (9) называется разностью первого порядка решетчатой функции f[n]

Δ2f(n)=Δ f[n+1]- Δf[n]- вторая разность

Δkf(n)=Δk-1f[n+1]- Δk-1f[n]- к-тая разность

Выражение значения решетчатой функции через ее конечные разности до порядка l включительно:

l

(10) f[n+l]= ∑ (kl) Δkf[n]; где (kt)=l!/k!(l-k)

k=0

РАЗНОСТНЫЕ УРАВНЕНИЯ .

Всякое соотношение, связывающую решетчатую функцию x[n] и ее разности до некоторого порядка K:

(11) Ф[n, x[n], Δ x[n],.., Δkx[n] =0, называется разностным уравнением. Соотношение (11) можно записать:

(12) Ф[n,x[n],x[n+1],x[n+2],...,x[n+k]=0, уравнение порядка K.

Рассмотрим пример.

(13) Δ3x[n]+ Δ2x[n]+2Δx[n]+2x[n]=f[n]

(13) можно переписать x[n+3]-2x[n+2]+3x[n+1]=f[n], если m=n+1, тогда:

(14) x[m+2]-2x[m+1]+3x[m]=f[m-1]

Таким образом, уравнение (13) является уравнением второго порядка.

Решетчатая функция x[n], которая обращает уравнение в тождество, называется решением разностного уравнения. Решение разностного уравнения (РУ) определяется наиболее просто, если (РУ) порядка К можно разрешить относительно функции x[n+k], т.е представить в виде:

(15) x[n+K]= F[n,x[n],x[n+1],...,x[n+k-1]]

Зададим К начальных условий при некотором значении аргумента n=n0: x[n0]=x0, x[n0+1]=x1,..., x[n0+K-1]=xk-1

Соотношение (15) определяет по заданным начальным условиям значение решения при n=n0+K. Используя значение x[n0+K], вычислим последовательно x[n0+K+1], x[n0+K+2] и все остальные x[n] при n≥n0+K.

Решение РУ (15) x[n]= ℰ[n,x0, x1,...,xk-1].

Рассматриваемая начальные условия мы получим общее решение уравнения (15) как функцию К произвольных постоянных C0,C1,..,Ck-1

(16) x[n]=ℰ[n,C0,C1,...,Ck-1]

Линейное РУ порядка К:

(17) a0[n]Δrx[n]+a1[n]Δr-1x[n]+....+ar[n]x[n]=f[n]

где r≥K, f[n], a0[n], a1[n], ... ,ar[n] - заданные решетчатые функции. Данное уравнение называется неоднородным РУ, если правая часть f[n]≠0, в противном случае это уравнение однородно.

Если решетчатые функции ℰ1[n], ... , ℰl[n] являются решением линейного однородного РУ:

x[n+K]+b1[n]x[n+K-1]+ ... +bk[n]x[n]=0, то функция

l

ℰ[n]= ∑ Ciξi[n], где (i=1,2, ... ,l) - произвольные постоянные,

i=1

также является его решением.

Совокупность К линейно независимых решений разностного однородного уравнения порядка К называется фундаментальной системой решений.

Если при n≥n0 существует фундаментальная система решений ℰ1[n],...,ℰk[n] однородного разностного уравнения, то общее решение этого уравнения выражается:

k

ℰ[n]= ∑ Ciℰi[n]

i=1

Общее решение линейного неоднородного разностного уравнения:

x[n+K]+b1[n]x[n+K-1]+ ... +bk[n]x[n]=f[n] равно сумме

частного решения ψ[n] и общего решения соответствующего однородного ур-я, т.е.

k

x[n]=ψ[n]+ ∑ Ciℰi[n]

i=1

где Ci - произвольные постоянные, Ei[n] - решение однородного уравнения, удовлетворяющие:

W(E1[n0],...,Ek[n0])≠0 (определитель).

Z - преобразования и его свойства.

![]()

|

|||||

|

|||||

![]()

![]() U

y t

U

y t

рис. 3.

Для изучения свойств и соотношений, связывающих входные и выходные последовательности системы, изображенной на рис.3, воспользуемся Z-преобразованием. (На рис.3 показана модель системы вход U с импульсным модулятором).

Определение Z-преобразование. функции U(0;∞) представляет собой функцию U комплексной переменной Z определяемую выражением:

∞

(18) U(z)=Z(U)= ∑ U(nT)Z-n , где

n=0

Т-период повторения импульсного модулятора.

Замечание: Если U имеет разрыв в любой дискретный момент kT, смысл соотношения (18) становится не вполне понятным. Поэтому будем всегда считать

U(nT)=U(nT+), n=0,1, ...

,т.е. все функции от времени, которые будут преобразовываться в дискретные, будут равны 0 для t<0, и если они непрерывны в некоторые дискретные моменты, то должны существовать значения U(nT-) и U(nT+).

Пример: функция времени z-преобразование

1(t) 1/(1-z-1)

[ВЮЮ4] e-αt 1/(1-z-1e-αt)

Согласно (18) U(z) определяется степенным рядом от z-1. Этот ряд сходится для всех z за пределами окружности |z|=Ru, где

![]() Ru=lim

SVp √ |U(nT)|

Ru=lim

SVp √ |U(nT)|

n→∞

Будем полагать, что каждая рассматриваемая функция имеет конечный радиус сходимости.

Если U является входом импульсного модулятора, то его выход равен

∞

U= ∑ U(kT)δ(t-kT)

k=0

Такая последовательность импульсов имеет преобразование Лапласа

∞

U(S)= ∑ U(kT)e-srT

k=0

Сравнивая (18) с данным соотношением, замечаем, что

U(z)|z=esT =U(S)

Th. Рассмотрим систему, изображенную на рис. 3. Пусть H(z) будет Z-преобразованием импульсной реакции h. Пусть у будет реакцией при нулевом состоянии на входе U, прикладываемый в момент t=0.

Тогда получим:

(19) Y(Z)=H(Z)U(Z) ,для |Z|>max(Ru,Rk)

Выражение (19) аналогично выражению Y(S)=H(S)V(S), которое устанавливает зависимость реакции при нулевом состоянии, импульсной реакции U входа непрерывной системы. По этой причине будем называть H(Z) дискретной передаточной функцией или передаточной функцией, Z-функцией.

∞

(20) H(Z)U(Z)= ∑ ylz-e=Y(Z), |Z|>max(Rh, Ru)

l=0

Формула для нахождения последовательности {y(kT)}, т.е. дискретного выхода.

Свойства Z-преобразования.

1. Теорема линейности.

Z(αf)=αZ(f ) ∀ комплексных чисел α, ∀|Z|>Rf

Z(f+g)=Z(f)+Z(g) ∀|Z|>max (Rf,Rg)

2. Теорема обращения

f(nT)=1/2∏j ⌡Г F(Z)Z-1 dZ, n=0,1,...,

где Г - любая замкнутая спрямляемая кривая, охватывающая начало координат и лежащая вне окружности |Z|=R>Rf.

3. Теорема о начальном значении.

f(0+)= lim F(Z)

Z→∞

4. Теорема сдвига.

Если F(Z) есть Z- преобразование последовательности {f0,f1,f2,...}, то Z-1F(Z) есть Z-преобразование последовательности {0,f0,f1,f2,...}.

1.6. СТРУКТУРНЫЕ СВОЙСТВА ОБЪЕКТОВ УПРАВЛЕНИЯ.

Введение: Реакция любой линейной системы содержит две составляющие: реакцию при нулевом входе и реакцию при нулевом состоянии, причем последняя характеризуется передаточной функцией.

Рассмотрим линейную стационарную систему У с несколькими входами и выходами описываемую уравнениями:

(1) x=Ax+Bu

(2) y=Cx+Du

где A,B,C,D- (n*n), (n*r), (p*n) и (p*r)- постоянные матрицы;

x- n-мерный вектор, характеризующий состояние данной системы;

u- входной r-мерный вектор, у- входной p-мерный вектор.

Будем говорить, что система У управляема, если при известных матрицах A и B и состоянии x0 системы при t0 можно найти некоторый вход u[t0,t0+T], который будет переводить систему из состояния x0 в нулевое состояние 0 в момент t0+T.

Опр. Система Ф, определенная уравнением (1) называется управляемой в том и только том случае, если для всех х0∈ℰN при начальном состоянии x0 системы в момент t=0 и некотором конечном T(T>0) найдется вход U[0,T]

такой, что:

(3) x(T;x0;0;U[0;T])=0

Опр. Состояние х1 системы У, описываемой уравнением (1), будем называть управляемым в том и лишь в том случае, если для некоторого конечного Т существует управление U[0,T] такое, что:

x(T;x1;0;U[0;T])=0

НАБЛЮДАЕМОСТЬ.

Понятие наблюдаемости тесно связано с понятием управляемости. Управляемость означает, что, зная начальное состояние и матрицы, характеризующие рассматриваемую систему, можно найти вход, который переводит это состояние в нулевое конечное время. Наблюдаемость означает, что знания матриц характеризующих систему, и реакции при нулевом входе Y[0,t] на конечном интервале достаточно для однозначного определения начального состояния данной системы.

Определение: система, описываемая (1) и (2) называется наблюдаемой в том случае, когда, для некоторого Т>0 и всех возможных начальных состояний х(0), значения матриц А и С и реакции при нулевом входе Y[0,t] достаточно, чтобы определить начальное состояние x(0).

Тh: Система, Y описываемая (1), (2) наблюдаема в том и лишь в том, случае, если на np столбцов матрицы Р=[С* ,А* С* ,..,А*(n-1) С* ] натянуто пространство состояний ℇ . ( Матрицы А*, С*,. получаются транспонированием матриц А, С,. и заменой их элементов комплексно сопряженными. )

ХАРАКТЕРИСТИКИ УПРАВЛЯЕМОСТИ.

Тh: Система Y , описываемая уравнением (1), управляема тогда и только тогда, когда на вектор столбцы В,АВ,..,B(n-1) матрицы Q≜[В,АВ,...,А(n-1)В] натянуто пространство состояний системы Y. Рассмотрим интерпритацию этой теоремы в терминах канонической экордановой формы матрицы системы. Такая форма позволяет определить управление, требуемое для перевода любого состояния в нулевое. Для простоты будем рассматривать систему с одним входом, описываемую уравнением:

(6) х=Ах+Вu

где А постоянная матрица порядка n, В -n-мерный вектор, u-скалярный вход.

Если минимальный многочлен матрицы А имеет степень k⋜ n-1, то система, характеризуемая уравнением (6), неуправляема.

Произведем замену переменных, положив х=Тy, причем матрица Т такова, что Т(-1)АТ=J, где J-каноническая форма Экордана матрицы А. Если обозначить е=Т(-1)В, то уравнение (6) преобразуется к виду:

(7) y=Jy+eU

Th. Пусть А имеет различные собственные значения, так что J=diag(ℷ1,...,ℷN). Тогда система, описываемая (6), управляема в том и только в том случае, когда все компоненты вектора e=Т-1В отличны от нуля.

1.7. СИГНАЛЫ В ЗАДАЧАХ УПРАВЛЕНИЯ И НАБЛЮДЕНИЯ ДИНАМИЧЕСКИХ ОБЬЕКТОВ.

Временная функция (форма передачи), передаваемая материальным параметром, называемым носителем информации или пространственное размещение (форма заполнения ), называется сигналом, если она по меньшей мере с помощью одного из ее параметров передает информацию.

пример:

![]()

![]()

![]() t t

t t

Носителем информации здесь является электрическое напряжение; информационным параметром амплитуда импульса. В качестве сигнала можно рассматривать временную функцию U(t) (математическую функцию).

Сигналы называются аналоговыми или дискретными, если они передают или изображают аналоговую или дискретную информацию. В аналоговых сигналах информационные параметры в пределах определенных границ могут принимать любое значение, а в дискретных сигналах они принимают только дискретные значения.

Дискретные сигналы, информационные параметры, которых могут принимать только два дискретных значения, называются двоичными.

Цифровыми сигналами являются закодированные дискретные сигналы, в которых дискретные значения информационного параметра соответствуют словам условного алфавита. Все дискретные сигналы не являющиеся цифровыми называются многозначными. Для классификации сигналов имеет значение разделения их на непрерывные и импульсные.

Сигналы называются непрерывными, если их информационные параметры изменяются в любой момент времени, и импульсными, если они изменяются в дискретные моменты времени.

Схема прохождения сигналов кибернетической системы представляет собой граничное изображение (статической и динамической) характеристик звеньев и связей с общей системой. Схема прохождения сигналов представляет собой графическое изображение математической модели системы. Математическая модель является совокупностью всех уравнений, которые описывают соотношение между всеми рассматриваемыми входными и выходными сигналами. Для изображения схем прохождения сигналов наиболее употребительны два способа, которые имеют определенные преимущества: способ изображения в виде структурной схемы и изображение в виде графа прохождения сигнала. При изображении схемы прохождения сигналов в виде структурной схемы звенья показываются в виде блоков, а стрелками указываются направления прохождения сигналов. Структурная схема представляет собой схематическое (качественное) изображение передаточных звеньев системы и ее связей через входные и выходные сигналы. Качественное описание характеристики звена с выходными сигналами U1,...,Um должна пониматься характеристика передачи в установившемся режиме, которая описывается статическим передаточным уравнением:

(1) xg=x(∞)=lim x(t)=f(U1,...,U v)

t→∞

в случае если существует х (∞).

Под динамическими характеристиками понимается зависимость выхода системы от ее входа в переходном процессе. Динамическая характеристика системы или звена может, быть описана различными способами.

Для аналоговых звеньев, входные и выходные характеристики которых изменяются непрерывно, характеристика передачи может быть, описана следующим дифференциальным уравнением в скалярной форме (после деления всех членов на коэффициент х”)

(2) xn +An-1 xn-1+...+A1 x+A0 x=Bm Um+...+B0 U

где U(t)-входной сигнал, x(t) выходной сигнал.

x=q1, x=q2, xn-1=qn получим уравнения системы для случая одномерного пространства:

(3) q(t)=Aq(t)+Bu(t)

x(t)=cTq(t)+du(t)

CКАЧКООБРАЗНАЯ И ПЕРЕХОДНАЯ ФУНКЦИИ.

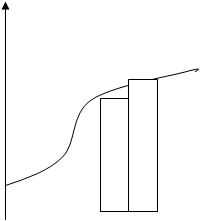

Передаточные свойства линейного звена характеризуются реакцией на скачкообразное изменение входного сигнала:

![]() us(t)=uоδ(t)= 0, при

t<0

us(t)=uоδ(t)= 0, при

t<0

u0, при t⋝0

здесь δ(t) является единичной скачкообразной функцией:

![]() δ(t)≜

0,

при

t<0

δ(t)≜

0,

при

t<0

1, при t⋝0

Значение скачкообразной функции основывается на том, что единичный входной сигнал u(t) может быть разложен на последовательность сдвинутых по времени скачкообразных функций с разными амплитудами.

![]()

u(t)

u(t)

![]()

![]()

![]()

![]() рис 1.

рис 1.

t

Благодаря применяемому для линейных систем методу суперпозиций соответствующий выходной сигнал можно получить путем наложения друг на друга реакций системы на отдельные скачкообразные функции. Реакция на единичное воздействие, хs(t) линейного звена:

xs(t)≜q us(t)=q U0δ(t) (4)

Переходная функция h(t) линейного звена:

(5) h(t)≜xs(t)/U0=q(t)

Переходная функция линейного звена представляет собой его реакцию на единичное воздействие, отнесенную к амплитуде скачка вх. сигнала.

ИМПУЛЬСНАЯ И ВЕСОВАЯ ФУНКЦИИ.

Аналогично скачкообразной функции и реакции на единичное воздействие импульсная функция и соответствующая реакция на импульсное воздействие могут служить для характеристики передаточных свойств линейных звеньев. Этот метод заключается в том, что входной сигнал u(t) может быть представлен в виде последовательных импульсов функций рис 2

|

|

||||

![]() 1/u u→0

1/u u→0

|

|||||

u u

рис 2 рис 3

Разложение сигнала в последовательность импульсных эвристическая интерпретация функций

Для хорошей аппроксимации, ширина u приведенных на рис. 2, 3 функций, должна быть ничтожно мала. Реакция на импульсное воздействие х(t) линейного звена:

(6) x↑(t)≜q*u↑(t)=q*A*δ(t)

(* -обозначается свертка функции u(t) и q(t) с помощью интеграла свертки); δ(t)-импульсная функция; А - площадь импульса u↑(t). Весовая функция q(t) линейного звена:

q(t)≜ x↑(t)/A=q*δ(t)

Весовая функция q(t) линейного звена представляет его реакцию на импульсное воздействие, отнесенную к интегралу от входного сигнала, взятому по времени.

В соответствии с общим значением импульсного сигнала (рис 3) следует, что весовая функция является свойством

передаточного звена, которое определяет его особенности при передаче сигнала. Схема прохождения сигнала: изображение в виде графа прохождения сигнала.

Граф представляет собой схему, состоящую из узлов и ветвей, соединяющих узлы. Граф прохождения сигналов, представляет собой граф с направленными ветвями.

|

|

x(t)=cu(t) узел x(p)=G(p)U(p)

x(t)=f{u(t)}

рис 4

При изображении схемы прохождения сигналов в виде графа, сигналы условно изображаются узлами, а звенья ветвями с указанием направления передачи. При этом принимается, что изображению временной функции (рис 4а) соответствует выражение:

x(t)=Cu(t) или x(t)=F{u(t)}

С - постоянная,F оператор, являющийся функцией времени.

![]()

![]()

![]() ДЕТЕТМЕНИРОВАННЫЕ СТОХАСТИЧЕСКИЕ

СИГНАЛЫ И СИСТЕМЫ.

ДЕТЕТМЕНИРОВАННЫЕ СТОХАСТИЧЕСКИЕ

СИГНАЛЫ И СИСТЕМЫ.

u u u

а) t б) t в) t

![]() u

u

а-в детерминированные сигналы

г

- стохастический сигнал

г

- стохастический сигнал

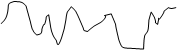

Рис. 5

![]() г) t

г) t

Характеристика сигналов, представленных на рис 5, а –в, очевидно, что может быть однозначно описана аналитической функцией для всех t, если характер этой зависимости сохраняется за пределами показанного интервала. Таким образом, значение в каждый момент времени t определено, т.е. детерминировано.

Но это не имеет место для сигнала, показанного на рис 5г. Его характеристика, замеренная в конечном интервале времени, может быть с большими трудностями и разной степенью точности описана на этом интервале. Отсюда, дальнейшее значение изменение сигнала, нельзя точно предугадать заранее. Временная характеристика таких сигналов является случайной функцией. Такие сигналы получаются из-за многих, причин, которые вследствие больших трудностей не могут быть достаточно проанализированы.

Подобного вида сигналы называются стохастическими сигналами.

Сигналы называются детерминированными, если их временная характеристика, может быть, однозначно определена.

Сигналы называются стохастическими, если их временные характеристики являются случайными функциями, причем для этих характеристик могут быть указаны общие статические параметры.

Если все сигналы в системе детерминированы, то также оказываются детерминированными временные характеристики всей системы.

Стохастические сигналы могут возникать в системе из-за того, что-либо входные сигналы являются стохастическими, либо определенные параметры системы подвержены случайным колебаниям.

Системы называются детерминированными, если все сигналы (вход, состояние, выход) детерминированы, и стохастическими, если, по крайней мере, один сигнал является стохастическим. В детерминированных системах возможна детерминированная обработка задачи управления, стохастическая система требует стохастической обработки.

1.8. МОДЕЛИ СЛУЧАЙНЫХ СИГНАЛОВ.

Величина, которая в каждом определенном случае в зависимости от результатов опыта может принимать то или иное числовое значение, называется случайной величиной. Конкретное значение, которое может принять случайная величина, называется возможным ее значением. Случайную величину можно определить как, функцию заданную на пространстве элементарных событий.

Случайные величины обозначают большими буквами латинского алфавита X,Y,Z,.., а возможные их значения соответствующими буквами x, y, z,...,. Случайная величина зависит, от элементарного события. Этот факт обозначается следующим образом Х=Х(ω).

Случайная величина, множество значений которой конечно или счетною, называется дискретной, случайной величиной.

ВЕКТОРНЫЕ (МНОГОМЕРНЫЕ) СЛУЧАИНЫЕ ВЕЛИЧИНЫ.

Кроме одномерных, случайных величин можно рассматривать многомерные, случайные векторы, координаты которых являются одномерными, случайными величинами. Такие случайные величины встречаются во многих технических задачах.

Случайные сигналы G и Х на входе и выходе системы автоматического регулирования (САР) с n -выходами и m -входами можно рассматривать n- и m- мерные, случайные векторы (рис 1)

|

|

![]()

![]()

![]()

![]() g2

x2

g2

x2

![]()

![]() X G

X G

gn xn![]()

![]()

GT=[g1,g2,...,gn] XT=[x1,x2,...,xn]

Случайные векторные величины будем обозначать жирными буквами латинского алфавита X,Y,Z, . Рассмотрим совокупность n случайных величин x1( ), x ( ),.., x ( )заданных на пространстве элементарных событий. Эти величины можно интегрировать как одну векторную, случайную величину:

(1) XT(ω)=[x1(ω),...,xn(ω)]

Случайная векторная величина принимает каждый раз значения, зависящие от элементарного события. Таким образом, многомерная, случайная величина есть вектор-функция, заданная на пространстве элементарных событий, и каждое ее возможное значение есть вектор.

ЧИСЛОВЫЕ ХАРАКТЕРИСТИКИ (МОМЕНТЫ) СЛУЧАЙНЫХ ВЕЛИЧИН.

Полными характеристиками случайных величин являются их функции распределения или плотности распределения вероятностей. Однако многие задачи теории вероятности можно решать, не используя функции распределения вероятностей. Оказывается, что статические свойства случайных величин могут быть описаны на основе числовых характеристик распределения этих случайных величин. Одной из наиболее важных числовых характеристик случайной величины является ее среднее значение, называемое также математическим ожиданием.

Математическим ожиданием М [Х] случайной величины Х называется число, определяемое интегралом вида:

∞

(2) mX=M[X]=⌡ xf(x)dx

-∞

где f(х) - плотность распределения вероятностей случайной величины Х, х - возможные ее значения.

Для дискретной, случайной величины Х, плотность распределения вероятностей есть сумма дельта - функций получим:

n n

(3) M[X]=x ∑ pk δ(x-xk)dx= ∑ xk pk

k=1 k=1

здесь хk возможное значение случайной величины, pk- вероятность того, что случайная величина примет значение хк.

Из равенства (3) следует, что математическое ожидание случайной дискретной величины Х равно сумме произведений возможных значений, принимаемых случайной величиной, на соответствующие им вероятности.

Отсюда вытекает вероятностный смысл математического ожидания, оно определяет координату центра группирования значений, принимаемых случайной величиной; следовательно, математическое ожидание является средним значением случайной величины.

Для непрерывной, случайной величины каждому ее возможному значению х соответствует элементарная вероятность f(х)dx . Если задана случайная величина Y, которая является неслучайной функцией Y=Ψ(x) случайного дискретного элемента Х, то Y принимает возможные значения уk=Ψ(хk) с вероятностями pk; поэтому математическое ожидание случайной величины Y=Ψ(х) аналогично равенству (3).

n

(4) M[Ψ(x)]= ∑ Ψ(xk)pk

k=1

Если Х - непрерывная, случайная величина, то функция от этой величины Y=Ψ(х) принимает возможные значенияΨ(x) с вероятностями f(х)dх. В этом случае сумма (4) после предельного перехода равна соответствующему интегралу:

∞

(5) M[Ψ(x)]= ⌡ Ψ(x)f(x)dx

-∞

Пологая, в формуле (5) Ψ(х)=хn получим выражение для моментов случайных величин Х.

Начальным моментом (или просто моментом) случайной величины Х называется математическое ожидание ее, n-ной степени. Этот момент обозначается αn т.е.

∞

(6) αn=M[Xn]= ⌡ xn f(x)dx

-∞

Очевидно, математическое ожидание не может дать полное представление о случайной величине, т.к. характеризует только ее среднее значение:

![]()

![]()

![]() * * * * **** x1

* * * * **** x1

0 m

![]()

![]()

![]() * *** *** * x2

* *** *** * x2

0 m

На рисунке 2 крестиками показаны значения, которые приняли случайные величины х1, х2. Эти случайные величины имеют одинаковые математические ожидания M[x1]=M[x2]=m, но разброс значений, который имеет случайная величина х2 около своего математического ожидания, больше чем разброс значений случайной величины х1.

Для характеристики величины разброса значений случайной величины около математического ожидания вводится еще одна характеристика случайной величины, равная сумме произведений квадратов отклонений, возможных значений случайной величины от математического ожидания на соответствующие этим возможным значениям вероятности.

Такая числовая характеристика называется дисперсией случайной величины Х и обозначается D[Х]. Для дисперсии случайной величины Х имеем:

n

(7) D[X]= ∑ (xk-M[X])2 pk

k=1

Очевидно, что чем больше дисперсия, тем больше разброс возможных значений случайной величины от математического ожидания. Из выражения (6) следует, что дисперсия есть математическое ожидание квадрата разности случайной величины и ее математического ожидания.

Для непрерывной, случайной величины Х формула (6) после предельного перехода принимает вид:

∞

(8) D[X]=M(X-M[X])2= ⌡ (x-M[X])2 f(x)dx

-∞

Разность между случайной величиной и ее математическим ожиданием называется центрированной случайной величиной Х○.

(9) X○=X-M[X]

Центральным моментом n-го порядка случайной величины Х называется математическое ожидание n-ой степени интегрированной случайной величины Х○, т.е.

∞

(10) μn=M[(X○)n]=M[X-M[X]n]= ⌡ (x-M[X]n) f(x)dx

-∞

Из формул (8), (9) следует, что дисперсия является центральным моментом второго порядка случайной величины. Дисперсия случайной величины имеет разность квадрата этой величины, однако, удобнее пользоваться мерой разброса случайной величины, имеющей ту же размерность, что и сама случайная величина. За эту меру принимают положительное значение квадратного корня из дисперсии и называют ее средним квадратичным отклонением.

![]()

![]() (11) δx=√ D[X] = √ μx

(11) δx=√ D[X] = √ μx

МОМЕНТЫ МНОГОМЕРНЫХ СЛУЧАЙНЫХ ВЕЛИЧИН.

Как и для одномерных, случайных величин, для случайных векторов вводят понятие начального и центрального моментов. Рассмотрим случайный n-мерный вектор - столбец Х с координатами х1, х2,...,хn

Смешанным начальным моментом порядка k1+k2 +,...,+kn случайных, величин х1, .. , хn называется математическое ожидание произведения

(12) αk1, k2,..., kn=M[x1k1, x2k2,..., xnkn]

![]() Смешанным центральным моментом порядка

k1, k2,..., kn случайных, величин х1 ,..,хn называется

математическое ожидание произведения (x1○)k1(x2○)k2..(xn○)kn

соответствующих центрированных случайных величин т.е.

Смешанным центральным моментом порядка

k1, k2,..., kn случайных, величин х1 ,..,хn называется

математическое ожидание произведения (x1○)k1(x2○)k2..(xn○)kn

соответствующих центрированных случайных величин т.е.

(13) μk1, k2,..., kn=M[(x1○)k1(x2○)k2...(xn○)kn]

Вычислим момент первого порядка для координат вектора X

(14) α0,..,0,1,0,..,0=M[(x1)○...(xi-1)○ xi (xi+1)○...(xn)○=M[xi]

Отсюда, следует, что начальные моменты первого порядка для системы n-случайных величин, есть математическое ожидание этих случайных величин.

Математическим ожиданием случайного вектора Х называется вектор, координатами которого являются математические ожидания соответствующих координат случайного вектора Х, т.е.

(15) M[X]T=M[x1]...M[xn]

Рассмотрим момент второго порядка, пусть имеем две случайные величины хi, уi. Вычислим смешанный центральный момент второго порядка. Согласно равенству (13) имеем:

(16) μ1,1=M(xi○yj○)

Смешанный центральный момент второго порядка случайных величин называется корреляционным моментом и обозначается Кij.

Кроме корреляционного момента двух случайных величин, для характеристики связи случайных величин введем безразмерный коэффициент rij, равный отношению корреляционного момента Kij случайных величин хi, уj к положительному значению квадратного корня из произведения дисперсией этих случайных величин. Этот коэффициент называется коэффициентом корреляции случайных величин т. е.

![]()

![]()

![]() Kij

Kij

(18) rij= √D[xi]D[xj]

Рассмотрим случайный вектор Х с коэффициентами х1, х2,.., хn. Матрица К, составленная из корреляционных моментов для всех координат этого случайного вектора:

![]()

![]() k11 k12 ......k1n

k11 k12 ......k1n

k21 k22 ......k2n

(19) K= ...................... =M[X○(X○)T]=[M[Xi○Xj○]]

kn1 kn2 ......knn

называется корреляционной матрицей случайного вектора Х. из свойств корреляционного момента следует, что Кij=Кji, т.е. матрица К является симметричной:

(20) КT=К

Пусть выполняется линейное преобразование случайного вектора Х, задаваемого в некотором базисе матрицей В, т.е.

(21) Y=ВХ

При линейном преобразовании (21) случайного вектора Х корреляционная матрица Y равна Кy=ВКxВT (22)

КОВАРЦИОННАЯ МАТРИЦА.

Если имеется не две, а большее число случайных величин, например, х1,...,хn, то резко возрастает и число числовых параметров, характеризующих эти величины. Кроме n-первых моментов, определяющих математическое ожидание случайных величин необходимо определение еще вторых центральных моментов, представляющих собой дисперсии каждой случайной величины и коварцией между каждой парой случайных величин. Всю совокупность случайных величин Х1,..., Хn, удобно представить в виде случайного вектора столбца:

![]()

![]() X1

__ __

X1

__ __

(23) X= ....... =(X1,...,Xn)T

Xn

Тогда совокупность математических ожиданий компонент этого вектора запишем в виде вектора математических ожиданий:

![]()

![]() x1

__ __

x1

__ __

(24) X=M[X]= ...... =(x1,...,xn)T

xn

Совокупность вторых центральных моментов, представляющих собой дисперсии:

(25) δ2xi=M[(xi-M[x])2] , i=1,...,n

и коварции

(26) cov(xixj)=M[(xi-M[xi])(xj-M[xj]) ,i, j=1,...,n, i≠j

Удобно записать в виде коварционной матрицы:

(27) Pxx=M[(X-M(X))(X-M(X)T)]

Диагональные члены этой матрицы представляют собой дисперсии. Коварционная матрица является симметричной.

ЭЛЕМЕНТЫ ТЕОРИИ СЛУЧАЙНЫХ ФУНКЦИЙ.

При изучении ряда явлений природы приходится наблюдать процессы, характеризуемые функциями, которые в зависимости от исхода опыта принимают различный вид. Указать заранее на то, какой вид примет случайная функция в данном опыте, невозможно, однако закономерности, присущие множеству значений, принимаемые случайной функцией, как закономерности массового явления можно изучить. Случайная функция как случайная величина, принимает различные значения в зависимости от исхода опыта элементарного события, кроме того, случайная функция зависит от некоторого неслучайного параметра t, например времени.

Если параметр t- время, то случайную функцию называют случайным процессом. Если зафиксировать элементарное событие ω=ω0, то Х(t,ω0) будет неслучайной функцией аргумента t. Конкретный вид случайной функции при фиксированном, т.е. возможном опыте, называется реализацией случайной функции.

Если зафиксировать параметр случайной функции t, т.е. рассмотреть сечение этой случайной функции при t=tk, то она будет зависеть только от элементарного события и, следовательно, станет случайной величиной Х(tk,ω).

Чтобы полностью задать случайную функцию Х(t), надо знать все n-мерные функции распределения: Fn(x1,...,xn; t1,..,tn), которые зависят от n переменных х1,...,хn и значений t1,...,tn, или плотности распределения вероятностей fn.

Важными характеристиками случайных величин являются моменты. Если известна двумерная функция распределения или плотность распределения вероятностей случайной функции, то всегда можно вычислить моменты случайной функции до второго порядка включительно, такими моментами являются математически ожидания;

∞

(1) M[X(t)]= ⌡ xf1[x,t]dx=mx(t)

-∞

дисперсия

∞

(2) D[X(t)]= ⌡ [x-mx(t)]2f1(x,t)dx=D1(t)

-∞

и корреляционный момент:

∞ ∞

(3) Kx(t1,t2)=M[X○(t1)X○(t2)]= ⌡ ⌡ (x1-mx(t1))(x2-mx(t2))

-∞ -∞

f2(x1,x2;t1,t2)dx1dx2, где

(4) X○(t)=X(t)-M[X(t)], центрированная случайная функция.

Если параметру t придавать все возможные значения, то математическое ожидание (1) и дисперсия (2) случайной функции будут функциями одной переменной t, а корреляционный момент (3) функцией двух переменных t1 и t2. Корреляционный момент Кx(t1,t2) называется корреляционной функцией случайной функции Х(t).

Математическое ожидания представляет собой среднее значение случайной функции Х(t)рис 2, а дисперсия характеризует отклонение значений, принимаемых случайной функцией, от ее математического ожидания.

Корреляционная функция характеризует зависимость между случайными величинами Х(t1) и Х(t2)-сечениями случайной функции при t=t1 и t=t2.

![]() x(t)

x(t)

![]() m(x)

m(x)

![]() t

t

Рис 2

Теория, изучающая случайные функции на основе знания первых двух моментов случайных функций, рис 2 называется корреляционной теорией.

Если известны математическое ожидание m(t) и корреляционная функция К(t1,t2) случайной функции Х(t), то всегда можно построить n-мерный вектор математического ожидания многомерной, случайной величины x(t1),...,x(tn) для фиксированных значений t1, t2,...,tn.

(5) mT=[m1, m2,..., mn]

и корреляционную матрицу этой случайной многомерной величины

![]()

![]() K(t1,t1) K(t1,t2) ..... K(t1,tn)

K(t1,t1) K(t1,t2) ..... K(t1,tn)

K(t2,t1) k(t2,t2) ..... K(t2,tn)

(6) K= ........................................

........................................

K(tn,t1) K(tn,t2) K(tn,tn)

НЕКОТОРЫЕ СВОЙСТВА КОРРЕЛЯЦИОННОЙ ФУНКЦИИ.

1. Корреляционная функция при одинаковых значениях аргументов равна дисперсии случайной функции, т.е.

K(t,t)=D(t)

2. При перемене местами аргументов корреляционная функция меняется на комплексно - сопряженную, т.е.

______

K(t1; t2)=K(t1, t2)

![]()

![]()

![]() 3. Для всякой

корреляционной функции справедливо неравенство:

3. Для всякой

корреляционной функции справедливо неравенство:

1) K(t1, t2) ≤√ D(t1)D(t2)

4. Корреляционная функция является положительно определенной функцией. Вместо корреляционной функции может быть рассмотрена безразмерная нормированная корреляционная функция R(t1, t2) определяемая равенством;

(t1, t2)

(5)

![]() R(t1, t2)=

R(t1, t2)=

![]() √ D(t1)D(t2)

√ D(t1)D(t2)

Из определения свойств корреляционной функции можно показать, что для нормированной корреляционной функции справедливо состояние:

_____ ______

R(t, t)=1 , R(t2,t1)=R(t1,t2) , R(t1,t2)≤1

В теории случайных чисел большую роль играет один из видов случайной функции, математическое ожидание которой равно 0, а корреляционная функция равна дельта функции. Такую случайную функцию называют белым шумом. Для белого шума как это следует из определения, справедливы равенства:

(6) M[X(t)=0

(7) K(t1, t2)=G(t) δ(t1-t2)

Функция G(t) называется интенсивностью белого шума. Дельта-функция при значении аргумента, отличном от 0, равна 0, поэтому для белого шума случайные величины, соответствующие двум сколь угодно близким значениям, являются некоррелированными.

Рассмотри систему из n случайных функций:

(8) X1(t),X2(t),...,Xn(t)

Каждая из функций этой системы характеризуется математическим ожиданием и корреляционной функцией. Однако необходимо еще ввести характеристику связи между отдельными случайными функциями системы (8).

Такой характеристикой является взаимная корреляционная функция двух случайных функций Xi(t) и Xi(t), и определяется равенством:

(9) Kxixj(t1,t2)=M[Xi○(t)Xj○(t)]

Для того, чтобы отличать взаимную корреляционную функцию, от корреляционной функции, последнюю называют также автокорреляционной.

Для взаимной корреляционной функции случайных функций Хi(t) и Yj(t) справедливы свойства:

________

(10) Kxy(t1, t2)=Kxy(t1, t2)

![]()

![]()

![]() (11) Kxy(t1, t2) ≤ √Dx(t1)Dy(t2)

(11) Kxy(t1, t2) ≤ √Dx(t1)Dy(t2)

Две случайные функции Х(t) и Y(t) называются некоррелированными, если их взаимная корреляционная функция тождественно равна нулю т.е.

(12) Kxy(t1, t2)=0

В ряде случаев удобно ввести безразмерную характеристику связи между случайными функциями нормированную взаимную корреляционную функцию:

Kxy(t1,t1)

![]() (13) Rxy(t1, t2)=

(13) Rxy(t1, t2)=

![]() √

Dx(t1)Dy(t1)

√

Dx(t1)Dy(t1)

ЛИНЕЙНЫЕ ОПЕРАЦИИ НАД СЛУЧАЙНЫМИ ФУНКЦИЯМИ.

Выясним, как образуются математические ожидания и корреляционные функции случайных функций при осуществлении над ними линейных операций:

1. Сложение случайных функций.

Возьмем две случайные функции X(t), Y(t). Пусть известны моменты этих функций до второго порядка включительно:

M[X(t)],M[Y(t)], Kx(t1,t2),Ky(t1,t2) Kxy(t1,t2)

Найдем математическое ожидание случайной функции:

(15) Z(t)=X(t)+Y(t)

В силу линейности операции определения математического ожидания имеем:

(16) M[Z(t)]=M[X(t)]+M[Y(t)]

т.е. математическое ожидание суммы случайных функций равно сумме математических ожиданий этих случайных функций.

Вычитая из равенства (15) равенство (16), получим центрированную случайную функцию:

(17) Z○(t)=X○(t)+Y○(t)