| Эконометрика (Яковлева А.В.) |

Эффективность МНК-оценок метода наименьших квадратовСвойство эффективности оценок неизвестных параметров модели регрессии, полученных методом наименьших квадратов, доказывается с помощью теоремы Гаусса-Маркова. Сделаем следующие предположения о модели парной регрессии: 1) факторная переменная xi – неслучайная или детерминированная величина, которая не зависит от распределения случайной ошибки модели регрессии i;

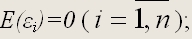

2) математическое ожидание случайной ошибки модели регрессии равно нулю во всех наблюдениях:

3) дисперсия случайной ошибки модели регрессии постоянна для всех наблюдений:;

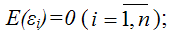

4) между значениями случайных ошибок модели регрессии в любых двух наблюдениях отсутствует систематическая взаимосвязь, т. е. случайные ошибки модели регрессии не коррелированны между собой (ковариация случайных ошибок любых двух разных наблюдений равна нулю):

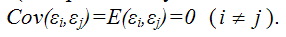

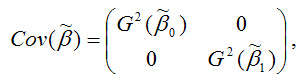

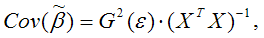

Это условие выполняется в том случае, если исходные данные не являются временными рядами; 5) на основании третьего и четвёртого условий часто добавляется пятое условие, заключающееся в том, что случайная ошибка модели регрессии – это случайная величина, подчиняющейся нормальному закону распределения с нулевым математическим ожиданием и дисперсией G2: i~N(0, G2). Если выдвинутые предположения справедливы, то оценки неизвестных параметров модели парной регрессии, полученные методом наименьших квадратов, имеют наименьшую дисперсию в классе всех линейных несмещённых оценок, т. е. МНК-оценки можно считать эффективными оценками неизвестных параметров 0 и 1. Если выдвинутые предположения справедливы для модели множественной регрессии, то оценки неизвестных параметров данной модели регрессии, полученные методом наименьших квадратов, имеют наименьшую дисперсию в классе всех линейных несмещённых оценок, т. е. МНК-оценки можно считать эффективными оценками неизвестных параметров 0…n. Для обозначения дисперсий МНК-оценок неизвестных параметров модели регрессии используется матрица ковариаций. Матрицей ковариаций МНК-оценок параметров линейной модели парной регрессии называется выражение вида:

где

Матрицей ковариаций МНК-оценок параметров линейной модели множественной регрессии называется выражение вида:

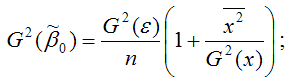

где G2() – это дисперсия случайной ошибки модели регрессии . Для линейной модели парной регрессии дисперсии оценок неизвестных параметров определяются по формулам: 1) дисперсия МНК-оценки коэффициента модели регрессии 0:

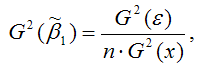

2) дисперсия МНК-оценки коэффициента модели регрессии 1:

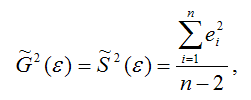

где G2() – дисперсия случайной ошибки уравнения регрессии ; G2(x) – дисперсия независимой переменой модели регрессии х; n – объём выборочной совокупности. В связи с тем, что на практике значение дисперсии случайной ошибки модели регрессии G2() неизвестно, для вычисления матрицы ковариаций МНК-оценок применяют оценку дисперсии случайной ошибки модели регрессии S2(). Для линейной модели парной регрессии оценка дисперсии случайной ошибки определяется по формуле:

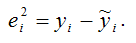

где

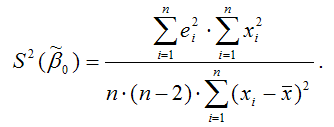

Тогда оценка дисперсии МНК-оценки коэффициента 0 линейной модели парной регрессии будет определяться по формуле:

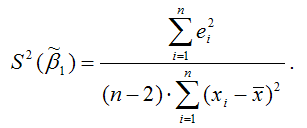

Оценка дисперсии МНК-оценки коэффициента 1 линейной модели парной регрессии будет определяться по формуле:

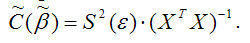

Для модели множественной регрессии общую формулу расчёта матрицы ковариаций МНК-оценок коэффициентов на основе оценки дисперсии случайной ошибки модели регрессии можно записать следующим образом:

Яковлева А.В. Эконометрика |

– дисперсия МНК-оценки параметра модели регрессии 0;

– дисперсия МНК-оценки параметра модели регрессии 0;

– дисперсия МНК-оценки параметра модели регрессии 1.

– дисперсия МНК-оценки параметра модели регрессии 1.

– это остатки регрессионной модели, которые рассчитываются как

– это остатки регрессионной модели, которые рассчитываются как